Photo par Ousa Chea sur Unsplash

Marzyeh Ghassemi, membre du corps professoral de Vector, a récemment contribué à un article de Viewpoint pour JAMA en ligne : Défis à la reproductibilité des modèles d’apprentissage automatique en soins de santé. Écrit par Ghassemi, Andrew L Beam et Arjun Manrai, l’article examine l’intersection entre l’apprentissage automatique et les soins de santé, ainsi que les avantages et défis de la reproductibilité et de la réplicabilité.

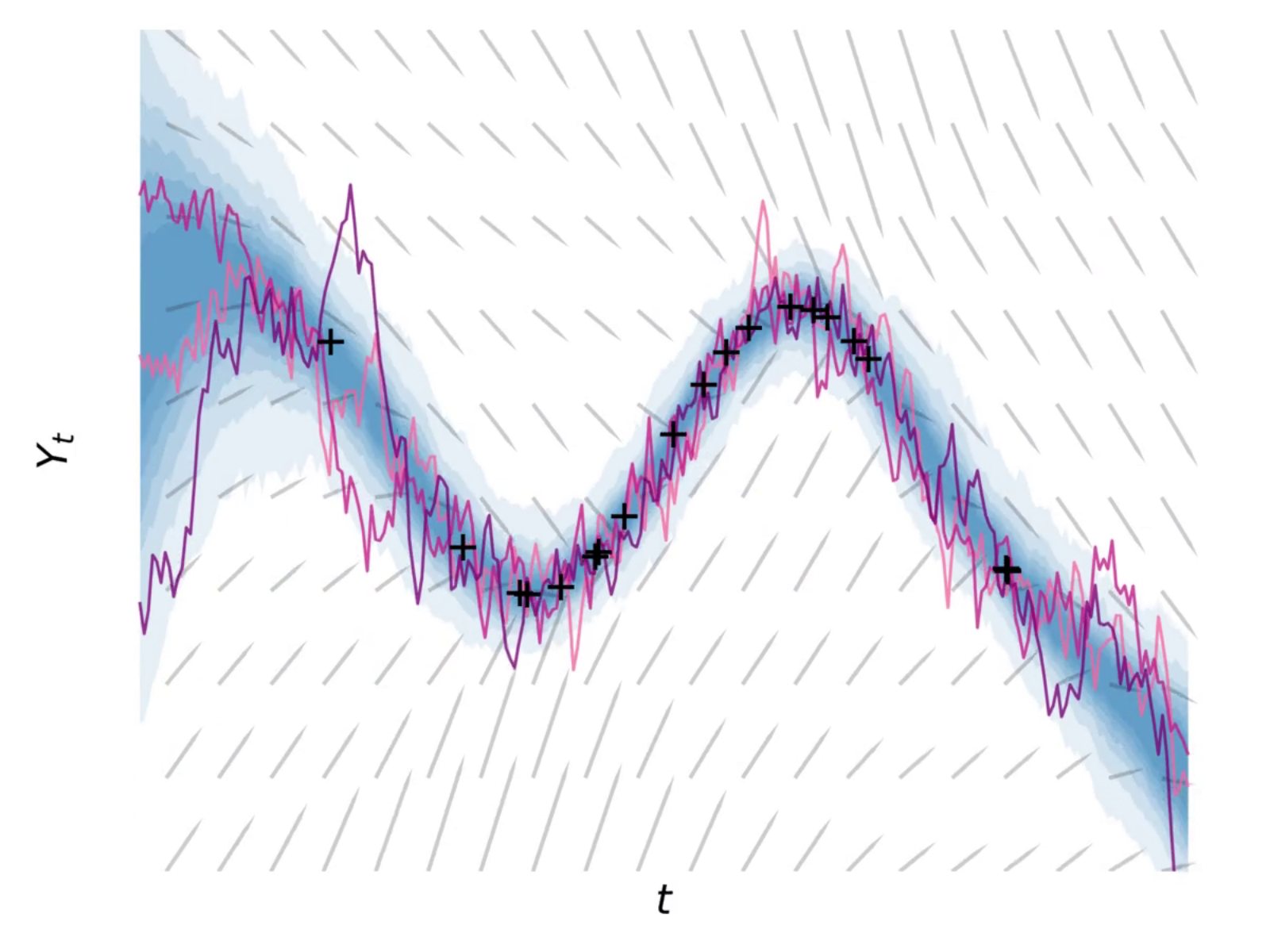

La reproductibilité fait référence à la capacité des chercheurs à obtenir les mêmes résultats que l’étude originale lorsqu’ils ont accès à ses données sous-jacentes et au code d’analyse. Cependant, même lorsqu’une étude est reproductible, avertissent les auteurs, cela ne signifie pas qu’elle est reproductible (lorsqu’une personne applique les mêmes méthodes à un autre ensemble de données), ni qu’on peut faire des généralisations à partir de ses résultats.

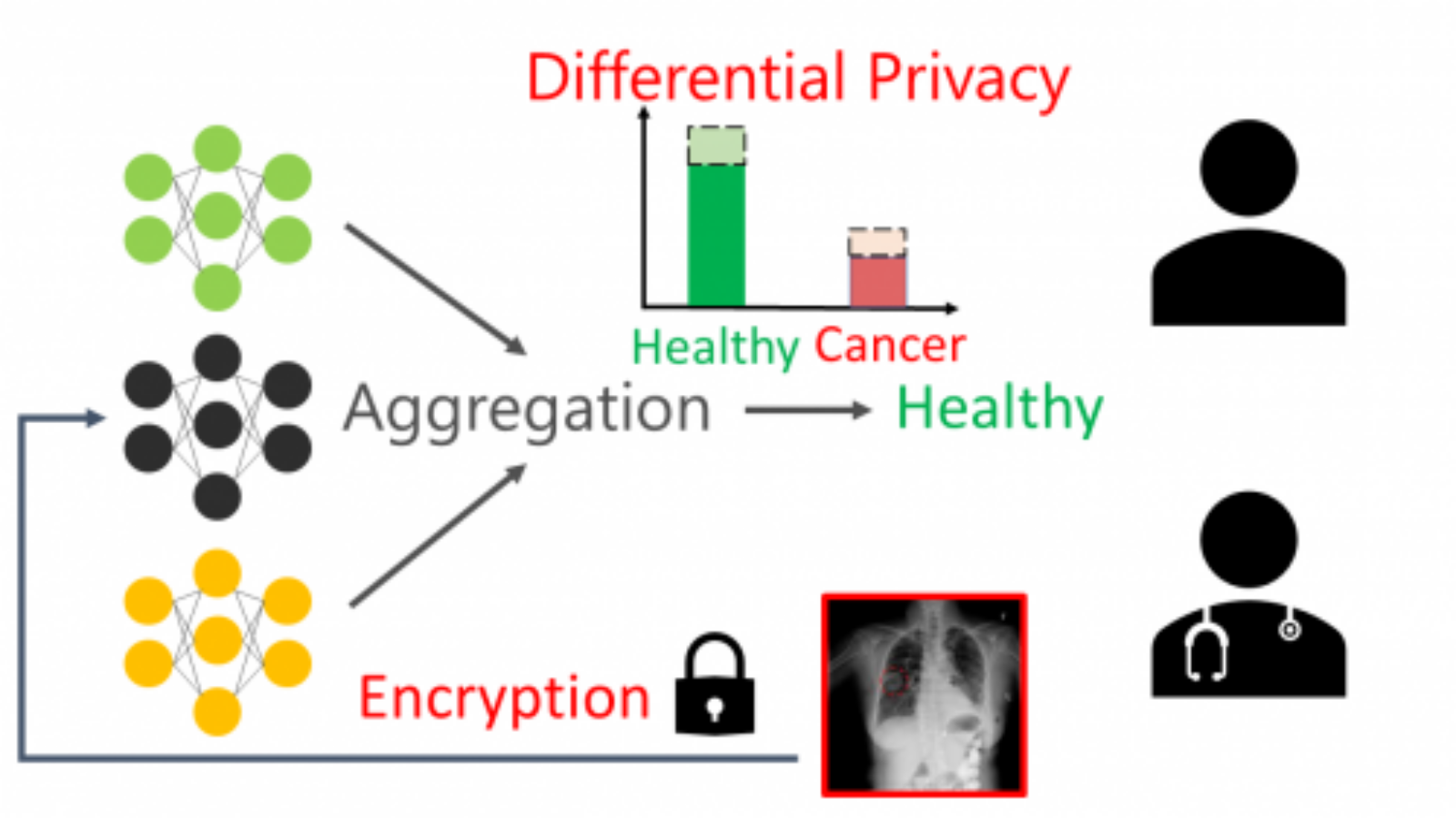

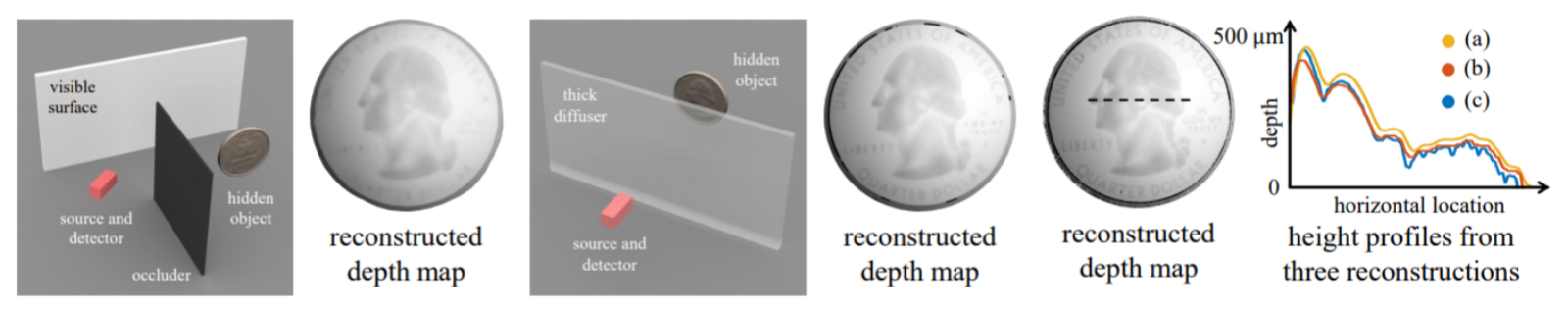

L’apprentissage automatique contribue à créer de nombreux nouveaux outils de prédiction clinique. Bien qu’elles offrent des améliorations potentielles à la qualité des soins pour les patients et des économies pour les hôpitaux, elles présentent aussi des défis et des obstacles uniques à la reproductibilité, un aspect qui doit être soigneusement considéré pour la sécurité des patients à mesure que ces techniques commencent à être déployées dans les hôpitaux.

« Il y a un effort important dans la communauté de l’apprentissage automatique pour créer des résultats solides », affirme Ghassemi. L’utilisation de modèles à haute capacité capables de modéliser de nombreuses relations entre plusieurs variables peut ajouter de la complexité à la reproductibilité; Souvent, des choix techniques sont faits par défaut, ou dans le cadre d’un processus d’installation, qui pourraient influencer le résultat d’une étude. « Un médecin ailleurs pourrait exécuter ce même modèle sur ses données et obtenir des résultats très différents. »

Le partage de code et l’accessibilité des données sont deux objectifs importants que Ghassemi estime qu’il faut toujours garder en tête. « Les risques à long terme de créer des résultats de niche non vérifiables en milieu clinique sont réels, et nous devrions investir dans une culture de la recherche qui permet la vérification intellectuelle. »