Un nouvel article de Xiaoxiao Li, membre du corps professoral de Vector, présente une nouvelle approche combinant l’apprentissage généralisé et personnalisé dans un système efficace capable de gérer l’hétérogénéité des données. Appelée synchronisation partagée et de groupe (SGPT), la méthode améliore la performance et améliore la sécurité ainsi que l’interprétabilité.

TLDR : Découvrez des recherches révolutionnaires en IA en 3 minutes

Ce résumé concis fait le pont entre les avancées scientifiques complexes et la compréhension quotidienne. Idéal pour les passionnés et les non-chercheurs, commencez à écouter dès maintenant.

« Débloquer le potentiel de l’ajustement des prompts pour relier l’apprentissage fédéré généralisé et personnalisé », coécrit par Wenlong Deng et Christos Thrampoulidis, montre comment cette approche innovante combine les forces de l’apprentissage généralisé (où une IA apprend à partir de diverses sources) et de l’apprentissage personnalisé (où une IA est adaptée à des utilisateurs spécifiques). La conception permet à l’algorithme de capturer à la fois des caractéristiques communes et spécialisées, facilitant ainsi un meilleur alignement avec diverses distributions locales de données sans nécessiter d’ajustements fins.

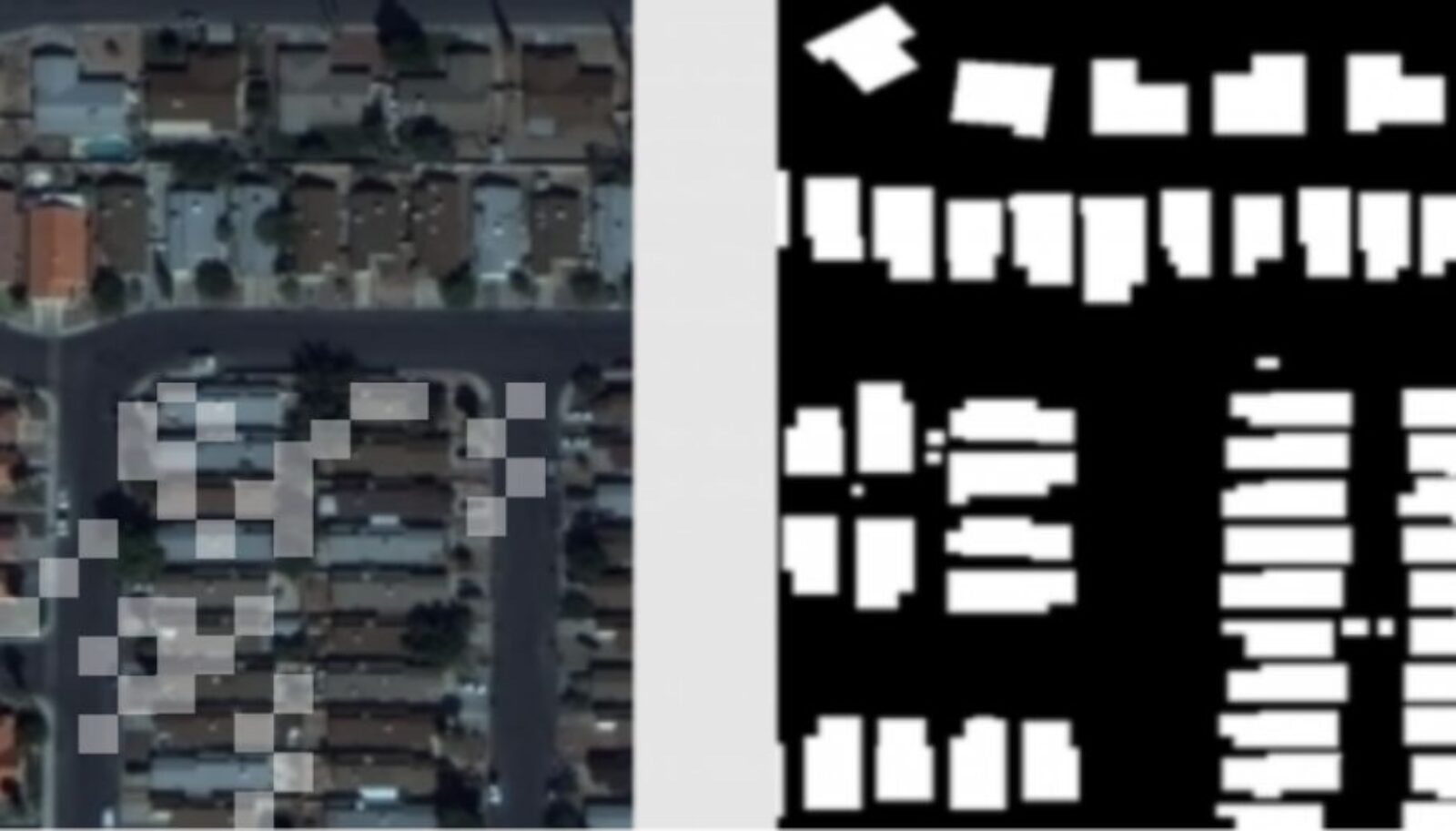

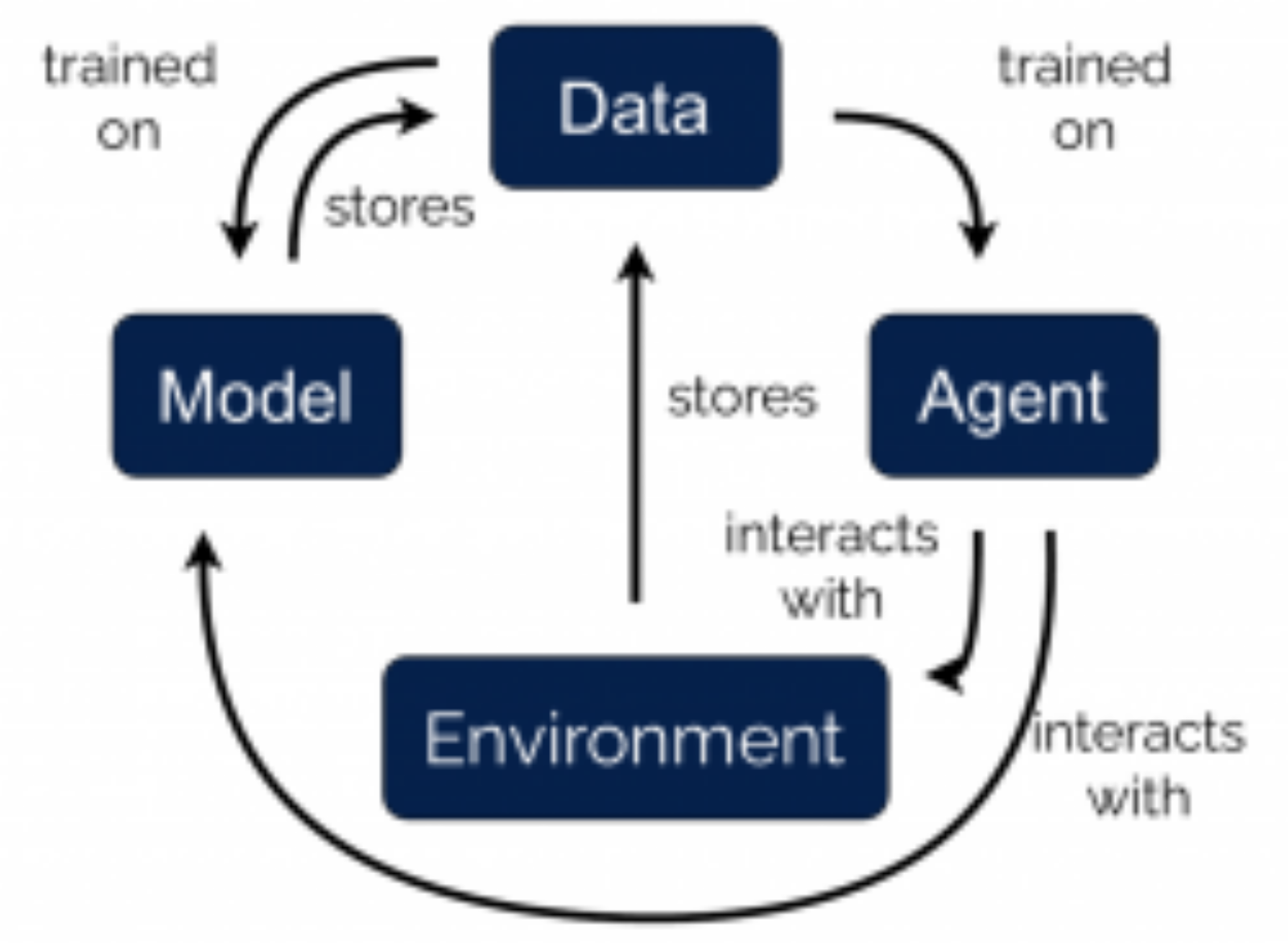

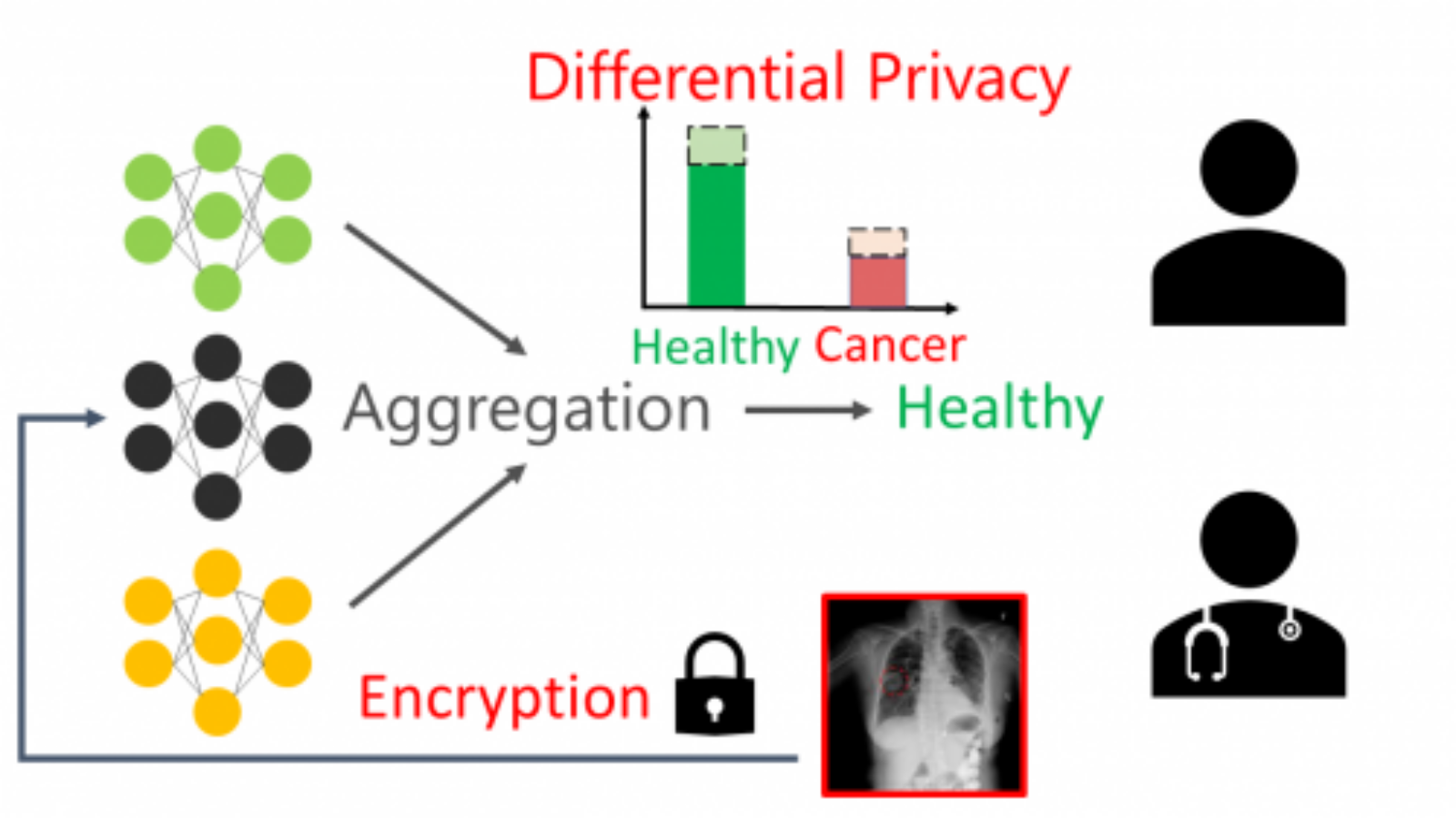

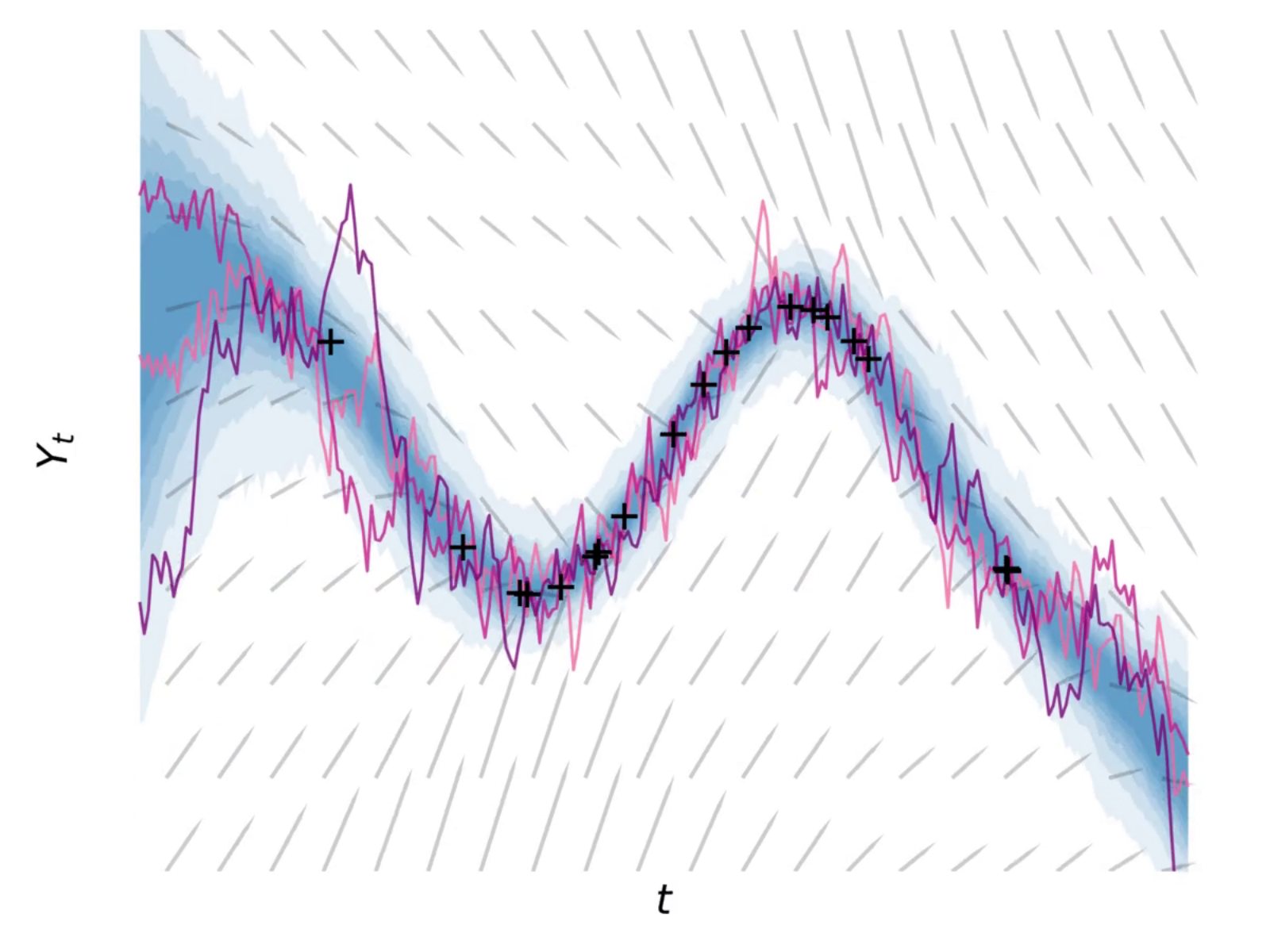

L’apprentissage fédéré vise à entraîner des modèles d’apprentissage automatique sur plusieurs clients sans partager leurs données, ce qui le rend crucial dans des domaines comme la vision par ordinateur. Cependant, l’hétérogénéité des données, caractérisée par des écarts de domaine ou des distributions de classes déséquilibrées, représente un obstacle important. Les méthodes traditionnelles généralisées d’apprentissage fédéré, qui apprennent un modèle global unique, ont souvent du mal avec une hétérogénéité significative des données. Les méthodes d’apprentissage fédéré personnalisées, qui adaptent les modèles à chaque client, peuvent entraîner un sur-ajustement.

Contexte et motivation

Les approches FL traditionnelles peuvent être largement catégorisées en FL généralisée (GFL) et FL personnalisée (PFL). GFL vise à apprendre un modèle global unique qui se généralise bien à tous les clients, tandis que PFL se concentre sur l’adaptation des modèles à chaque client ou groupe de clients. Les deux approches présentent des limites : la GFL a du mal avec une hétérogénéité significative des données, tandis que la PFL peut surajuster aux données locales et ne pas se généraliser aux clients hors fédération.

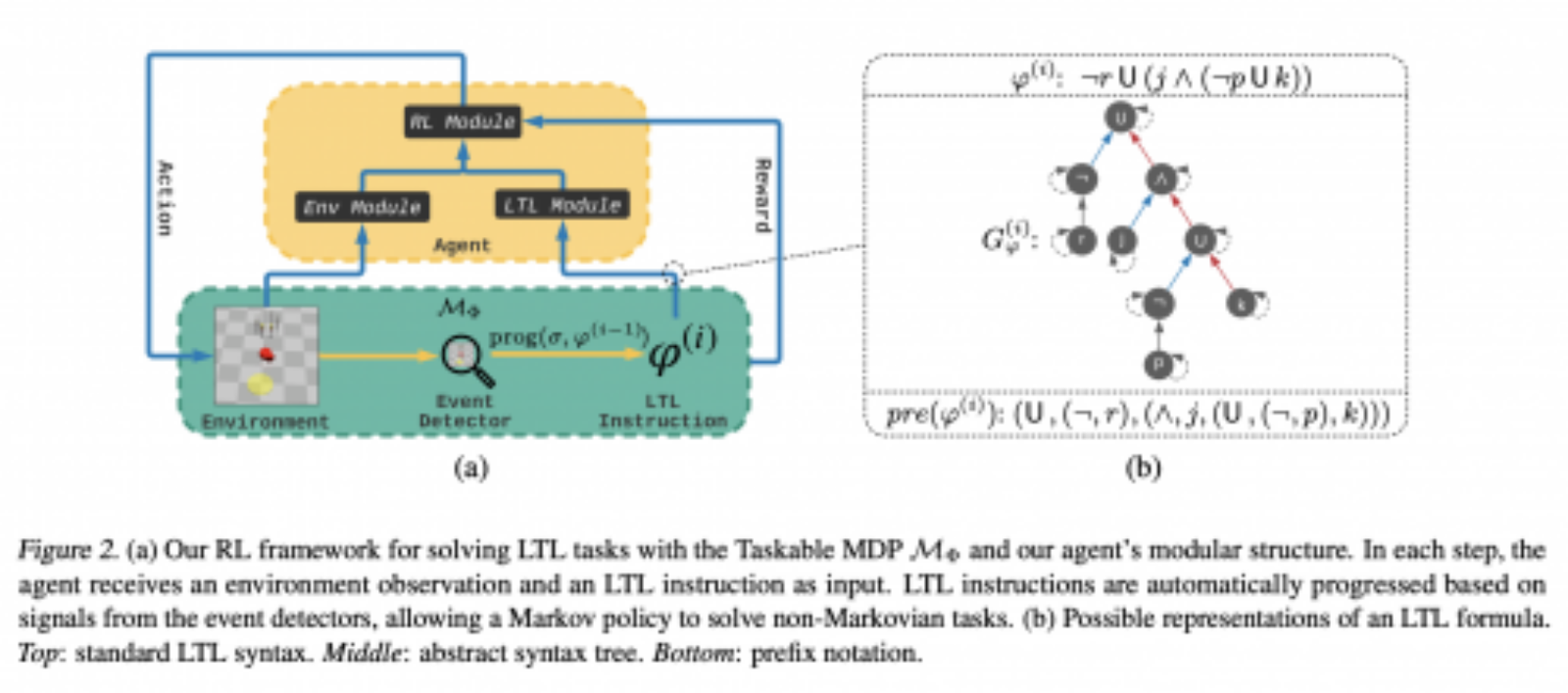

Pour relever ces défis, les auteurs introduisent le SGPT, un algorithme novateur qui combine les avantages du GFL et du PFL. SGPT exploite la puissance des transformateurs de vision (ViTs), qui, bien que traditionnellement considérés comme gourmands en calcul, ont récemment bénéficié de méthodes de réglage efficaces en paramètres, comme l’ajustement rapide, qui améliorent grandement leur efficacité, les rendant bien adaptés à la méthode FL. En appliquant des techniques d’ajustement prompt, SGPT établit un cadre FL flexible et efficace, optimisé pour l’ajustement de modèles dans des environnements distribués.

Méthodologie SGPT

L’idée centrale derrière SGPT est d’apprendre à la fois les prompts partagés et spécifiques au groupe, permettant au modèle de capturer les caractéristiques communes à tous les clients tout en s’adaptant aux caractéristiques propres au groupe. Voici un aperçu des éléments clés :

- Prompts partagés : Ils sont conçus pour capturer des représentations communes chez tous les clients. Ils sont attachés aux premières couches du modèle ViT, où les caractéristiques ont tendance à être plus uniformes entre différentes classes.

- Prompts de groupe : Ces prompts sont conçus pour extraire des informations spécialisées pour différents groupes de données. Ils sont insérés dans des couches supérieures du ViT, où les caractéristiques deviennent plus diverses et spécialisées.

- Module de sélection d’invite : Ce module utilise une approche de regroupement basée sur la similarité pour assigner des points de données à des groupes spécifiques. Il apprend un ensemble de clés pour chaque groupe et sélectionne l’invite de groupe appropriée en fonction de la similarité entre les caractéristiques d’entrée et les clés apprises.

- Optimisation par descente de coordonnées par bloc (BCD) : Pour entraîner efficacement les invites, SGPT utilise une approche BCD. Elle optimise d’abord les prompts partagés pour apprendre des informations communes, puis optimise les prompts de groupe pour extraire des connaissances plus spécialisées

Les auteurs présentent plusieurs techniques pour améliorer la stabilité et l’efficacité de leur approche :

- Étalonnage de la fonction de sélection en utilisant la probabilité de sélection accumulée pour éviter l’effondrement en quelques groupes.

- Agrégation des paramètres de momentum pour les clés et les invites de groupe afin d’assurer la cohérence de la sélection et des connaissances.

Analyse théorique

L’article propose une analyse théorique de l’écart entre la performance globale et locale du modèle SGPT. Les auteurs identifient deux facteurs clés qui influencent cet écart :

- Généralisation : liée au nombre d’échantillons dans chaque groupe.

- Divergence de distribution : la différence entre la distribution globale des groupes et la distribution locale de chaque client.

SGPT traite ces facteurs en utilisant des invites partagées dans les premières couches pour maximiser la taille de l’échantillon pour les caractéristiques communes, et en regroupant les invites dans les couches supérieures pour minimiser les divergences de distribution pour diverses caractéristiques.

Mise en place et résultats expérimentaux

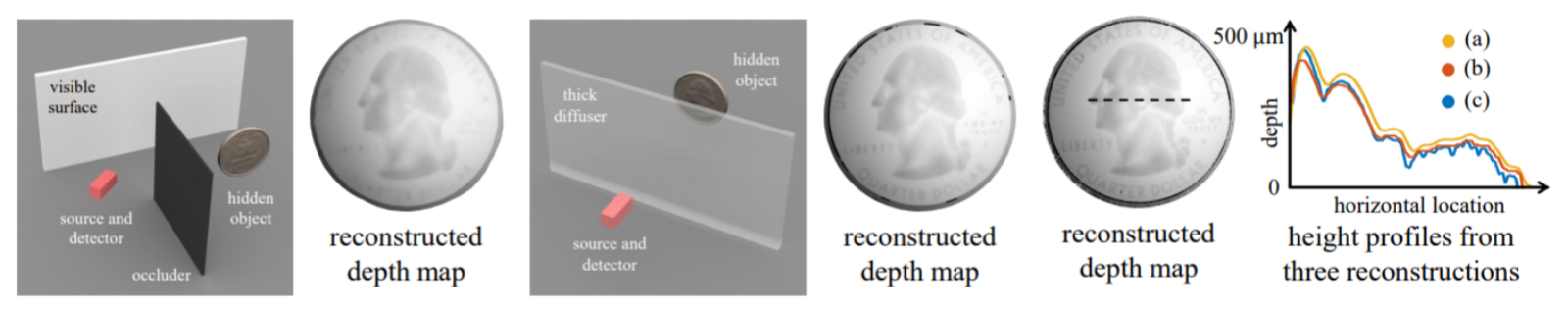

Les auteurs ont mené des expériences approfondies sur divers ensembles de données pour évaluer la performance de SGPT sous des conditions d’hétérogénéité des étiquettes et d’hétérogénéité des caractéristiques :

Hétérodégénéité des étiquettes :

- CIFAR-100 : 100 clients, chaque client ayant attribué des données provenant d’un nombre spécifique de classes (s).

- Cinq ensembles de données : une séquence de 5 ensembles de données (SVHN, CIFAR10, non-MNIST, Fashion-MNIST et MNIST) répartis sur 20 clients.

Hétérodégénéité des caractéristiques :

- Office-Caltech10 : quatre domaines de données avec 10 classes chacun.

- DomainNet : six domaines avec les dix classes les plus fréquentes.

Les expériences ont comparé SGPT à plusieurs méthodes de référence, dont FedVPT, FedMix, pFedPG, FedEM et FedPR. Les résultats ont démontré que le SGPT surpassait constamment ces références à travers différents niveaux d’hétérogénéité et ensembles de données.

Les principales conclusions incluent

- Le SGPT a obtenu une précision globale et une pire précision locale comparativement à d’autres méthodes, indiquant une meilleure performance sur les distributions de données globales et locales.

- Le SGPT a montré une robustesse face à des niveaux croissants d’hétérogénéité des données, avec des baisses de performance plus faibles comparativement à d’autres méthodes à mesure que l’hétérogénéité augmentait.

- Dans les expériences d’hétérogénéité des caractéristiques, SGPT a obtenu les plus fortes précisions moyennes tant sur les ensembles de données Office-Caltech10 que DomainNet.

Les auteurs ont également mené des études d’ablation pour analyser l’impact des différents composants du SGPT :

- La combinaison des questions partagées et de groupes a conduit à des améliorations significatives tant de la précision globale que de la pire localisation.

- La stratégie proposée d’optimisation de la descente des coordonnées par bloc s’est avérée cruciale pour l’entraînement efficace des invites.

- Le module de sélection de prompts avec mise à jour de momentum a amélioré la performance et la stabilité du clustering.

Conclusion et implications

L’algorithme SGPT représente une avancée significative dans l’apprentissage fédéré, comblant efficacement le fossé entre les approches généralisées et personnalisées. En tirant parti des techniques d’ajustement prompt et de la puissance des transformateurs de vision, SGPT démontre une performance supérieure dans la gestion de l’hétérogénéité des données entre les clients.

Les innovations clés de SGPT – les invites partagées et de groupe, le module de sélection des prompts et la stratégie d’optimisation BCD – offrent un cadre flexible capable de s’adapter à la distribution globale et locale des données sans nécessiter d’ajustements locaux. Cette approche améliore non seulement la performance, mais maintient aussi l’efficacité, avec beaucoup moins de paramètres entraînables comparativement aux méthodes FL traditionnelles.

Alors que l’apprentissage fédéré continue de gagner en importance dans les applications d’apprentissage automatique préservant la confidentialité, des méthodes comme SGPT, capables de gérer efficacement des distributions de données hétérogènes, seront cruciales pour les déploiements réels. Des recherches futures pourraient explorer l’application de techniques similaires de réglage des prompts à d’autres types de modèles au-delà des transformateurs de vision, ainsi que l’étude de la scalabilité et de l’efficacité de communication de telles approches dans des systèmes d’apprentissage fédérés à grande échelle.

Créé par l’IA, édité par des humains, à propos de l’IA

Cet article de blogue fait partie de notre série « ANDERS – IA Développements notables expliqués & recherche simplifiée ». Ici, nous utilisons des agents d’IA pour créer des brouillons initiaux à partir de travaux de recherche, qui sont ensuite soigneusement édités et affinés par nos humains. L’objectif est de vous offrir des explications claires et concises des recherches de pointe menées par des chercheurs en Vector. Grâce à ANDERS, nous nous efforçons de combler le fossé entre les avancées scientifiques complexes et la compréhension quotidienne, en soulignant pourquoi ces développements sont importants et comment ils impactent notre monde.