Les chercheurs de Vector ont apporté des contributions significatives à la Conférence internationale sur les représentations de l’apprentissage (ICLR) de cette année, le principal lieu mondial de recherche sur l’apprentissage de la représentation et l’apprentissage profond, qui se tiendra du 23 au 27 avril 2026 à Rio de Janeiro, au Brésil.

Le portefeuille de recherche de Vector lors de l’ICLR 2026 a démontré le leadership de l’institut dans les domaines clés de la représentation, de l’apprentissage et de l’IA. Nos articles acceptés couvrent des avancées fondamentales en apprentissage par renforcement pour le raisonnement avancé, des percées en IA générative et systèmes multimodaux, des travaux pionniers sur les agents d’IA autonomes, des contributions cruciales à une IA fiable et responsable, ainsi que des applications innovantes en découverte scientifique et en soins de santé.

Ces contributions reflètent le travail collaboratif de 60 membres du corps professoral Vector, affiliés du corps professoral Vector et boursiers postdoctoraux distingués Vector, incluant 11 articles collaboratifs. Les chercheurs de Vector ont également dirigé 6 des 40 ateliers acceptés, façonnant directement 15% des discussions les plus ciblées de la conférence. Ces contributions soulignent le double engagement de la communauté Vector à faire progresser à la fois la science fondamentale de la façon dont les réseaux neuronaux apprennent les représentations et le développement de systèmes d’IA ayant un impact concret; nos chercheurs repoussent les limites du possible en IA tout en veillant à ce que ces avancées profitent à la société.

Vous trouverez ci-dessous la liste complète de 48 articles acceptés, incluant des collaborations, provenant de membres du corps professoral de Vector, d’affiliés du corps professoral de Vector et de boursiers postdoctoraux distingués de Vector.

Peut-on générer des représentations portables pour les séries temporelles cliniques à l’aide de LLM?

Zongliang Ji, Yifei Sun, Andre Amaral, Anna Goldenberg (membre du corps professoral Vector), Rahul G. Krishnan (membre du corps professoral Vector)

Résumé :

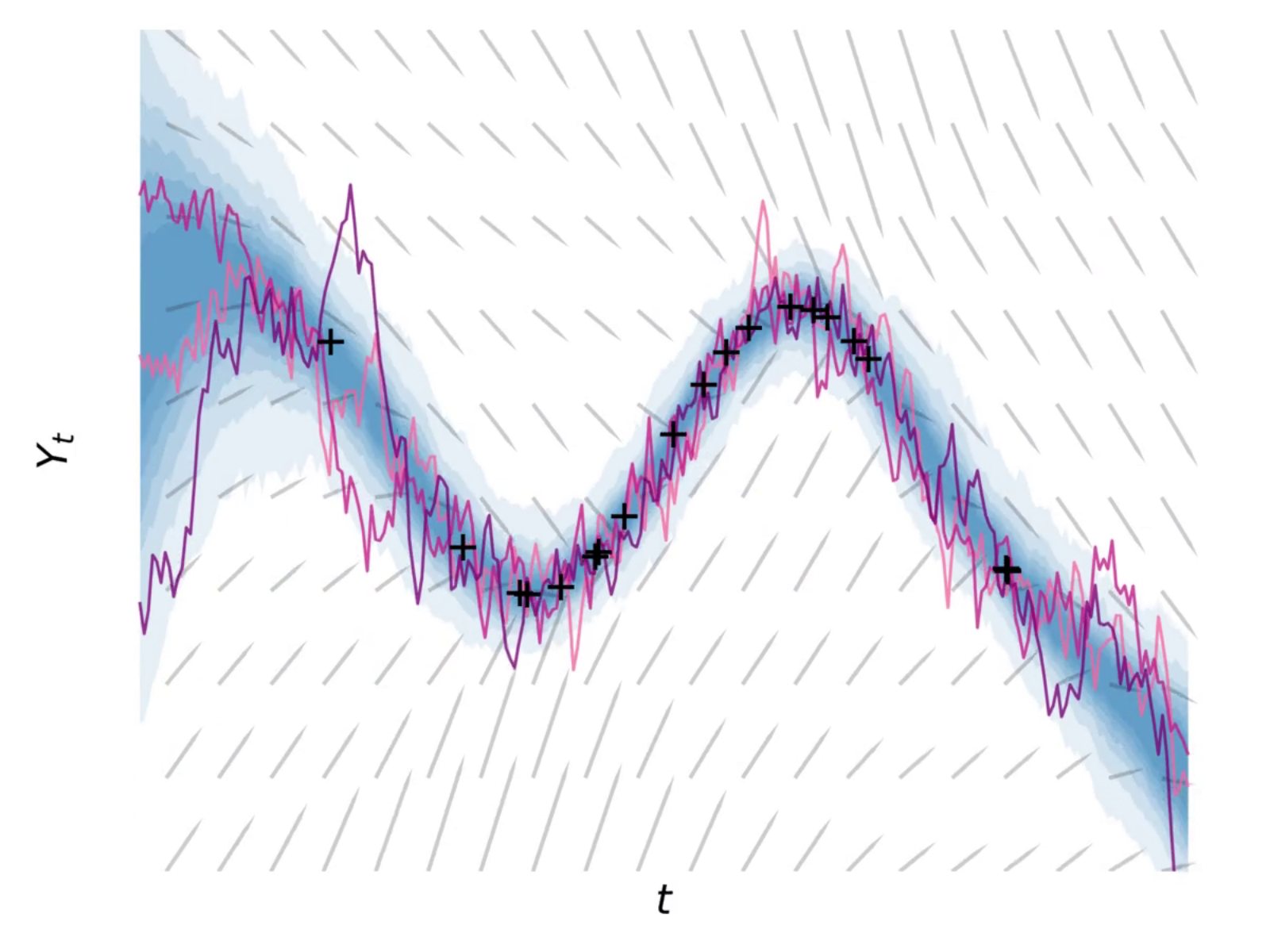

Le déploiement de l’apprentissage automatique clinique est lent et fragile : les modèles qui fonctionnent dans un hôpital se dégradent souvent sous les quarts de distribution du suivant. Dans ce travail, nous étudions une question simple : les grands modèles de langage (LLM) peuvent-ils créer des embeddings portables de patients, c’est-à-dire des représentations de patients, permettre à un prédicteur en aval construit sur un hôpital d’être ailleurs avec peu ou pas de réentraînement ni d’ajustement fin. Pour ce faire, nous cartographions des séries temporelles irrégulières des USI vers des résumés concis en langage naturel à l’aide d’un LLM congelé, puis nous intégrons chaque résumé avec un modèle d’inclusion de texte figé afin d’obtenir un vecteur de longueur fixe capable de servir d’entrée à divers prédicteurs en aval. À travers trois cohortes (MIMIC-IV, HIRID, PPICU), sur plusieurs tâches de prévision et de classification cliniquement fondées, nous constatons que notre approche est simple, facile à utiliser et étonnamment compétitive avec l’in-distribution avec l’imputation en grille, l’apprentissage de représentation auto-supervisé et les modèles de fondation de séries temporelles, tout en présentant des baisses de performance relative plus faibles lors du transfert vers de nouveaux hôpitaux. Nous étudions la variation de performance selon la conception des invites, les consignes structurées étant cruciales pour réduire la variance des modèles prédictifs sans modifier la précision moyenne. Nous constatons que l’utilisation de ces représentations portables améliore l’apprentissage en poings et n’augmente pas la récupérabilité démographique de l’âge ou du sexe par rapport aux références, ce qui suggère peu de risques supplémentaires pour la vie privée. Nos travaux soulignent le potentiel que détiennent les LLM comme outils pour permettre le déploiement évolutif de modèles prédictifs de qualité production en réduisant la surcharge d’ingénierie.

TLDR : Explorez la capacité des LLM à générer des représentations portables et transférables pour les séries temporelles des USI

Jay Zhangjie Wu, Xuanchi Ren, Tianchang Shen, Tianshi Cao, Kai He, Yifan Lu, Ruiyuan Gao, Enze Xie, Shiyi Lan, Jose M. Alvarez, Jun Gao, Sanja Fidler (membre du corps professoral Vector), Zian Wang, Huan Ling

Résumé :

Les avancées récentes dans les grands modèles génératifs ont considérablement fait progresser le montage d’images et la génération d’images en contexte, mais une lacune cruciale subsiste pour assurer la cohérence physique, où les objets édités doivent rester cohérents. Cette capacité est particulièrement vitale pour les tâches liées à la simulation du monde. Dans cet article, nous présentons ChronoEdit, un cadre qui recadre le montage d’images comme un problème de génération vidéo. Premièrement, ChronoEdit traite les images d’entrée et montées comme la première et la dernière image d’une vidéo, ce qui lui permet d’exploiter de grands modèles génératifs vidéo préentraînés qui capturent non seulement l’apparence de l’objet, mais aussi la physique implicite du mouvement et de l’interaction grâce à la cohérence temporelle apprise. Deuxièmement, ChronoEdit introduit une étape de raisonnement temporel qui effectue explicitement l’édition au moment de l’inférence. Dans ce cadre, la trame cible est conjointement dénomise avec des jetons de raisonnement pour imaginer une trajectoire d’édition plausible qui contraint l’espace de solution à des transformations physiquement viables. Les jetons de raisonnement sont ensuite abandonnés après quelques étapes pour éviter le coût computationnel élevé du rendu d’une vidéo complète. Pour valider ChronoEdit, nous introduisons PBench-Edit, un nouveau benchmark des paires image-invite pour des contextes nécessitant une cohérence physique, et démontrons que ChronoEdit dépasse les références de pointe tant en fidélité visuelle qu’en plausibilité physique.

Bowen Wang, Xinyuan Wang, Jiaqi Deng, Tianbao Xie, Ryan Li, Yanzhe Zhang, Junli Wang, Dunjie Lu, Zicheng Gong, Gavin Li, Toh Hua, Wei-Lin Chiang, Ion Stoica, Diyi Yang, Yu Su, Yi Zhang, Zhiguo Wang, Victor Zhong (membre du corps professoral de Vector), Tao Yu

Résumé :

À mesure que les agents d’utilisation informatique (ACU) se multiplient et deviennent de plus en plus performants, l’évaluation est devenue plus difficile : les benchmarks statiques et manuellement sélectionnés sont étroits en domaine, sujets à la contamination et très axés sur l’environnement, et ils divergent considérablement de l’évaluation réelle dirigée par l’utilisateur. Nous présentons Computer Agent Arena, une plateforme open source pour l’évaluation directe des ACUA et une méthodologie dynamique qui transforme les préférences humaines en rétroaction structurée dans des environnements réalistes. Le système (i) simule l’utilisation réelle de l’ordinateur via des initialisations et personnalisations d’environnements diversifiés et dynamiques hébergés dans le nuage; (ii) assure une comparaison authentique et équitable en reproduisant fidèlement les CUA open source et en les exécutant anonymement dans des environnements contrôlés et appariés; et (iii) étend l’évaluation au-delà de la préférence par paires et de la correction vers les signaux axés sur la capacité et le comportement. À travers 2 201 votes de haute qualité sur 12 agents — couvrant des interactions multi-applications, des instructions ambiguës et des requêtes ouvertes — nous observons des renversements de classement frappants par rapport aux benchmarks statiques. Des analyses plus approfondies montrent que la correction globale influence principalement la préférence humaine; Au-delà de cela, l’interaction agent-humain et l’auto-correction favorisent les préférences des utilisateurs, même lorsque l’accomplissement global des tâches est comparable. Notre analyse d’erreurs révèle des erreurs de comportement des agents, telles que la mémoire à long horizon et les échecs d’actions détaillés que les benchmarks statiques ne parviennent pas à évaluer. Nous comparons également les agents purement GUI aux agents numériques universels capables d’utiliser des outils et de coder, et discutons des compromis entre ces différentes philosophies de conception. Nous rendons open source la plateforme complète, le jeu de données collecté et le code de Computer Agent Arena pour soutenir la recherche future sur l’évaluation et le développement de CUA.

Génération cohérente du texte en image via la décontextualisation des scènes

Song Tang, Peihao Gong, Kunyu LI, Kai Guo, Boyu Wang (affilié de la faculté Vector), Mao Ye, Jianwei Dr Zhang, Xiatian Zhu

Résumé : La génération cohérente texte-to-image (T2I) cherche à produire des images préservant l’identité du même sujet à travers diverses scènes, mais elle échoue souvent en raison d’un phénomène appelé changement d’identité (DI). Les méthodes précédentes ont réglé ce problème, mais reposent généralement sur l’hypothèse irréaliste de connaître toutes les scènes cibles à l’avance. Cet article révèle qu’une source clé de changement de DI est la corrélation native entre le contexte sujet et la scène, appelée contextualisation de scène, qui surgit naturellement lorsque les modèles T2I s’adaptent à la distribution d’entraînement d’images naturelles vastes. Nous prouvons formellement la quasi-universalité de cette corrélation scène-sujet et en déduisons des limites théoriques sur sa force. Sur cette base, nous proposons une nouvelle approche d’édition d’intégration de prompts sans entraînement, appelée Décontextualisation de la Scène (SDeC), qui impose un processus d’inversion de la contextualisation intégrée de la scène de T2I. Plus précisément, il identifie et élimine la corrélation latente scène-sujet dans l’intégration de l’invite ID en quantifiant la stabilité directionnelle SVD pour repondérer adaptativement les valeurs propres correspondantes. De façon cruciale, SDeC permet une utilisation par scène (une invite par scène) sans avoir besoin d’accès préalable à toutes les scènes cibles. Cela en fait une solution très flexible et générale, bien adaptée aux applications réelles où ces connaissances préalables sont souvent indisponibles ou varient au fil du temps. Les expériences démontrent que SDeC améliore considérablement la préservation de l’identité tout en maintenant la diversité des scènes.

Critique-Coder : Améliorer les modèles de codeurs par critique l’apprentissage par renforcement

Chi Ruan, Dongfu Jiang, Yubo Wang, Wenhu Chen (membre du corps professoral de Vector)

Résumé :

L’apprentissage par renforcement (RL) est devenu un paradigme d’entraînement populaire, particulièrement lorsqu’il est associé à des modèles de raisonnement. Bien qu’efficace, il se concentre principalement sur la génération de réponses et ne dispose pas de mécanismes pour encourager explicitement la critique ou la réflexion. Plusieurs études récentes, comme Critique-Fine-Tuning (CFT) et Critique-Guided Distillation (CGD), ont démontré les avantages d’enseigner explicitement aux LLM comment critiquer. Motivés par eux, nous proposons l’apprentissage par renforcement critique (CRL), où le modèle a pour mission de générer une critique pour une paire donnée (question, solution). La récompense est déterminée uniquement par le fait que l’étiquette du jugement final $c \in \{\texttt{Vrai}, \texttt{Faux}\}$ de la critique générée s’aligne avec le jugement fondé sur la vérité $c^*$. En s’appuyant sur ce point, nous introduisons \textsc{Critique-Coder}, qui est entraîné sur un hybride de RL et CRL en substituant 20% des données RL standard par des données CRL. Nous peaufinons plusieurs modèles (\textsc{Critique-Coder}) et les évaluons selon différents benchmarks pour montrer leurs avantages par rapport aux modèles uniquement en RL. Nous montrons que \textsc{Critique-Coder} surpasse constamment les références RL uniquement sur tous les benchmarks évalués. Notamment, notre \textsc{Critique-Coder-8B} peut atteindre plus de 60\% sur LiveCodeBench (v5), surpassant d’autres modèles de raisonnement comme DeepCoder-14B et GPT-o1. Au-delà de la génération de code, \textsc{Critique-Coder} démontre aussi des capacités de raisonnement général améliorées, comme en témoigne sa meilleure performance sur les tâches de raisonnement logique à partir de l’ensemble de données BBEH. Cela indique que l’application de la CRL aux ensembles de données de codage améliore les capacités générales de raisonnement et de critique, qui sont transférables à un large éventail de tâches. Ainsi, nous croyons que le CRL fonctionne comme un excellent complément au RL standard pour le raisonnement des LLM.

Algorithmes de notation de vraisemblance cross-tokenizer pour la distillation des modèles de langage

Truong Buu Phan, Ashish Khisti (affiliée à la faculté Vector), Karen Ullrich

Résumé :

Computing the next-token likelihood ratio between two language models (LMs) is a standard task in training paradigms like knowledge distillation. Since this task requires both models to share the same probability space, it becomes challenging when the teacher and student LMs use different tokenizers, for instance, when edge-device deployment necessitates a smaller vocabulary size to lower memory overhead. In this work, we address this vocabulary misalignment problem by uncovering an implicit recursive structure in the commonly deployed Byte-Pair Encoding (BPE) algorithm and utilizing it to create a probabilistic framework for cross-tokenizer likelihood scoring. Our method enables sequence likelihood evaluation for vocabularies different from the teacher model native tokenizer, addressing two specific scenarios: when the student vocabulary is a subset of the teacher vocabulary, and the general case where it is arbitrary. In the subset regime, our framework computes exact likelihoods and provides next-token probabilities for sequential sampling with only $\mathcal{O}(1)$ model evaluations per token. When used for distillation, this yields up to a 12\% reduction in memory footprint for the Qwen2.5-1.5B model while also improving baseline performance up to 4\% on the evaluated tasks. For the general case, we introduce a rigorous lossless procedure that leverages BPE recursive structure, complemented by a fast approximation that keeps large-vocabulary settings practical. Applied to distillation for mathematical reasoning, our approach improves GSM8K accuracy by more than 2% over the current state of the art.

TLDR : Des algorithmes pour calculer des séquences de jetons sous un vocabulaire BPE cible différent du tokeniseur natif du modèle.

Machine de Darwin Gödel : évolution ouverte des agents auto-améliorants

Jenny Zhang, Shengran Hu, Cong Lu, Robert Lange, Jeff Clune (membre du corps professoral de Vector)

Résumé :

La plupart des systèmes d’IA actuels sont limités par des architectures fixes conçues par l’humain et ne peuvent pas s’améliorer de façon autonome et continue. La méthode scientifique, quant à elle, est un système cumulatif et ouvert, où chaque innovation s’appuie sur des artefacts antérieurs, permettant ainsi de futures découvertes. L’espoir grandit que le processus manuel actuel de développement de l’IA pourrait lui-même être automatisé. Si c’est fait de façon sécuritaire, une telle automatisation accélérerait le développement de l’IA et nous permettrait d’en récolter les bénéfices beaucoup plus rapidement. Cette perspective soulève la question de savoir comment les systèmes d’IA peuvent s’améliorer sans fin tout en s’améliorant dans la résolution de problèmes pertinents. Le méta-apprentissage peut automatiser la découverte de nouveaux algorithmes, mais il est limité par des améliorations de premier ordre et la conception humaine d’un espace de recherche approprié. La machine de Gödel a proposé une alternative théorique : une IA auto-améliorée qui se modifie à plusieurs reprises de manière démontrable et bénéfique. Malheureusement, prouver que la plupart des changements sont bénéfiques nets est impossible en pratique. Nous introduisons la Darwin Gödel Machine (DGM), un système novateur d’auto-amélioration qui modifie itérativament son propre code (améliorant ainsi sa capacité à modifier sa propre base de code) et valide empiriquement chaque modification à l’aide de benchmarks de codage. Inspiré par l’évolution darwinienne et la recherche sur l’ouverture, le DGM développe une archive d’agents de codage générés. Elle échantillonne des agents de cette archive, qui s’auto-modifient pour créer de nouvelles versions intéressantes d’eux-mêmes. Cette exploration ouverte forme un arbre croissant d’agents diversifiés et de haute qualité et permet l’exploration parallèle de nombreux chemins différents à travers l’espace de recherche. Empiriquement, le DGM améliore automatiquement ses capacités de codage (par exemple, de meilleurs outils d’édition de code, gestion des fenêtres à long contexte, mécanismes d’évaluation par les pairs), augmentant la performance sur le banc logiciel de 20,0% à 50,0%, et sur Polyglot de 14,2% à 30,7%. De plus, la DGM surpasse largement les références sans amélioration personnelle ni exploration ouverte. Toutes les expériences étaient menées avec des précautions de sécurité (par exemple, bac à sable, surveillance humaine). Dans l’ensemble, le DGM représente une étape importante vers l’amélioration de l’IA, capable de rassembler ses propres étapes sur un chemin qui mène à une innovation sans fin.

Angelo Porrello, Pietro Buzzega, Felix Dangel (ancien boursier postdoctoral distingué Vector), Thomas Sommariva, Riccardo Salami, Lorenzo Bonicelli, Simone Calderara

Résumé :

L’arithmétique des tâches (TA) offre une façon modulaire et évolutive d’adapter les modèles de fondation. La combinaison de plusieurs vecteurs de tâches, cependant, peut entraîner des interférences entre tâches, provoquant une dérive de représentation et une dégradation des performances. La régularisation par dérive de représentation offre un remède naturel pour démêler les vecteurs de tâches, mais les approches existantes nécessitent généralement des données de tâches externes, ce qui entre en conflit avec les contraintes de modularité et de disponibilité de l’AT comme les préoccupations de confidentialité. Nous proposons une approche sans données en encadrant la régularisation par dérive de représentation comme un problème d’approximation de matrice de courbure. Cela nous permet de tirer parti de techniques bien établies; en particulier, nous adoptons la courbure approximative faite par Kronecker (KFAC) pour obtenir des régularisateurs pratiques. Notre méthode est sans données, présente une complexité constante par rapport au nombre de tâches et améliore la performance sur les benchmarks TA.

TLDR : Nous abordons l’interférence inter-tâches dans l’arithmétique des tâches avec une approche sans date. En considérant la dérive comme une approximation de courbure et en appliquant K-FAC, nous obtenons un démêlement de tâches évolutif et une amélioration des performances de benchmark.

Diviser et abstraire : Autoformalisation via la décomposition et l’apprentissage par abstraction

Marcus Min, Yeqi Gao, Wilson Sy, Zhaoyu Li, Xujie Si (affilié de la faculté Vector), Osbert Bastani

Résumé :

L’autoformalisation, la tâche de traduire les mathématiques informelles en langages formels vérifiables par machine, a longtemps été un défi, même pour des énoncés individuels. Au-delà du niveau des énoncés, les mathématiciens investissent des efforts considérables pour formaliser des abstractions réutilisables telles que les définitions et relations communes, sur lesquelles un grand corpus d’énoncés peut être facilement formalisé. Alors que les travaux antérieurs se concentrent sur l’ajustement fin des modèles pour l’autoformalisation d’une seule énoncé, nous introduisons $\textit{Divide and Abstract (DNA)}$, un cadre de bout en bout qui améliore non seulement la performance des modèles en temps de test pour formaliser un corpus d’énoncés, mais qui apprend aussi une bibliothèque d’abstractions formelles réutilisables, qui évolue vers des énoncés en dehors du corpus. Premièrement, $\textit{DNA}$ extrait des concepts mathématiques courants de l’ensemble du corpus informel et les formalise comme des abstractions réutilisables. Conditionné à ces abstractions savantes, $\textit{DNA}$ décompose chaque énoncé informel du corpus en une collection structurée de propositions informelles, traduit chaque clause en correspondants formels, compose les propositions formelles à nouveau, et affine la formalisation finale donnée par un validateur symbolique. L’ensemble du cadre ne nécessite aucune formation et s’adapte donc à tout langage formel, en particulier aux langages spécifiques au domaine (DSL) à faible ressource. $\textit{DNA}$ améliore significativement la performance jusqu’à $\textbf{8.6}\times$, et fait avancer le SOTA de $\textbf{57.8}$\% de $\textbf{40.8}$ à $\textbf{64.4}$.

TLDR : Nous avons conçu un cadre qui améliore non seulement les LLM pour formaliser un corpus d’énoncés, mais apprend aussi une bibliothèque d’abstractions réutilisables, qui s’étend à des énoncés en dehors du corpus.

Yubo Gao, Renbo Tu, Gennady Pekhimenko (membre du corps professoral Vector), Nandita Vijaykumar (membre du corps professoral Vector)

Résumé :

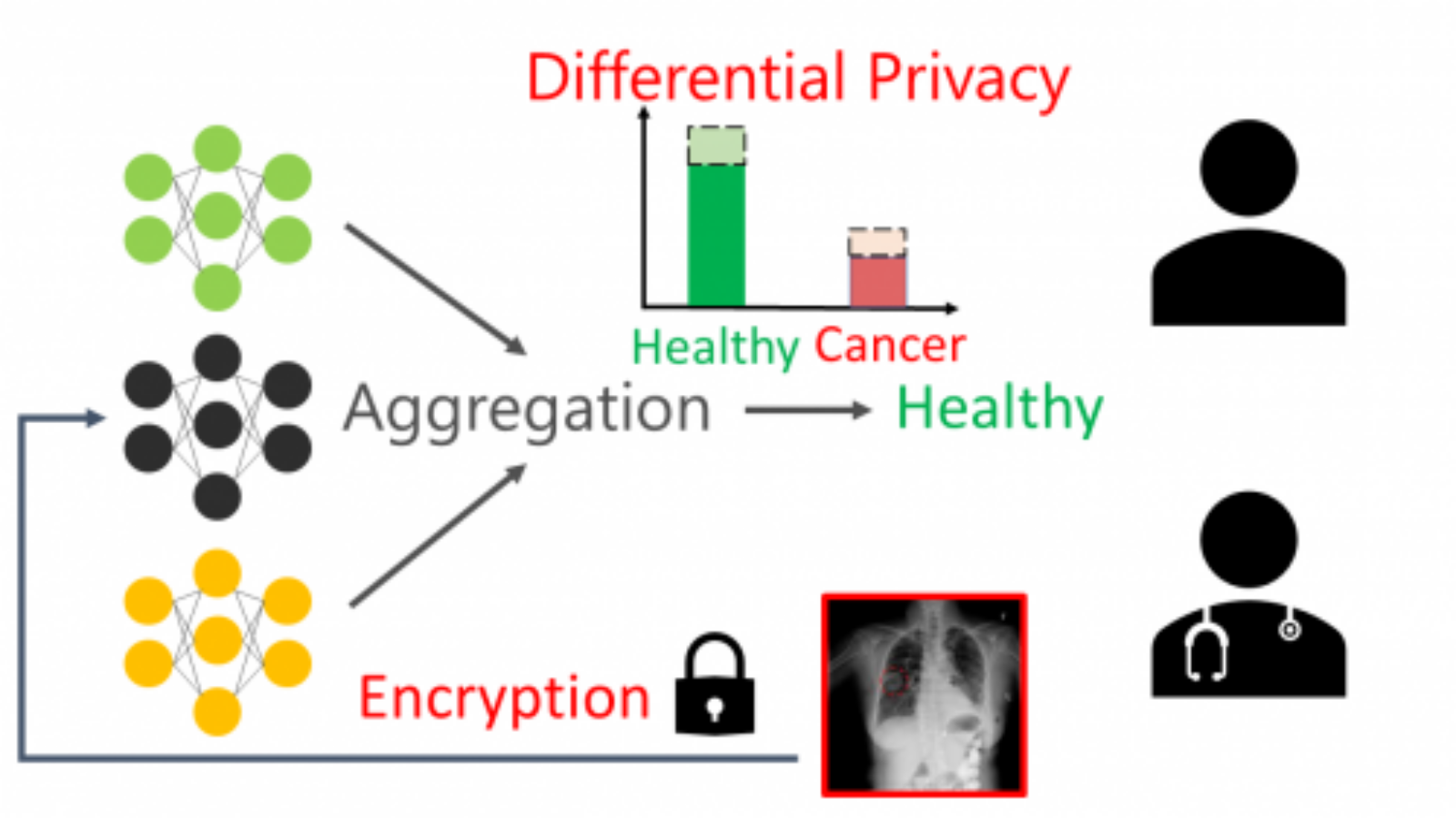

Le SGD différiellement privé (DP-SGD) est une technique puissante pour protéger la vie privée des utilisateurs lors de l’utilisation de données sensibles pour entraîner des réseaux de neurones. Pendant l’entraînement, convertir les poids et les activations du modèle en formats de basse précision, c’est-à-dire la quantification, peut réduire drastiquement les temps d’entraînement, la consommation d’énergie et les coûts, et constitue donc une technique largement utilisée. Dans ce travail, nous démontrons que la quantification cause une dégradation de précision significativement plus élevée dans le DP-SGD comparativement au SGD ordinaire. Nous observons que cela est causé par l’injection de bruit dans le DP-SGD, qui amplifie la variance de quantification, entraînant une dégradation de précision disproportionnée. Pour relever ce défi, nous présentons DPQuant, un cadre de quantification dynamique qui sélectionne de façon adaptative un sous-ensemble changeant de couches à quantifier à chaque époque. Notre méthode combine deux idées clés qui réduisent efficacement la variance de quantification : (i) l’échantillonnage probabiliste des couches qui fait tourner quelles couches sont quantifiées à chaque époque, et (ii) la priorisation des couches conscientes des pertes, qui utilise un estimateur de sensibilité aux pertes différentiellement privés pour identifier les couches pouvant être quantifiées avec un impact minimal sur la qualité du modèle. Cet estimateur consomme une fraction négligeable du budget total de confidentialité, préservant ainsi les garanties DP. Des évaluations empiriques sur ResNet18, ResNet50 et DenseNet121 à travers divers ensembles de données démontrent que DPQuant surpasse constamment les bases de quantification statiques, obtenant des compromis de précision et de calcul presque optimaux de Pareto et des améliorations théoriques allant jusqu’à 2,21 $ $ sur du matériel de faible précision, avec une baisse de la précision de validation de moins de 2%.

DrivingGen : Un benchmark complet pour les modèles de vidéos génératives en conduite autonome

Yang Zhou, Hao Shao, Letian Wang, Zhuofan Zong, Hongsheng Li, Steven Waslander (affilié de la faculté Vector)

Résumé :

Les modèles de génération vidéo, en tant qu’une forme de modèles, sont devenus l’une des frontières les plus passionnantes de l’IA, promettant aux agents la capacité d’imaginer l’avenir en modélisant l’évolution temporelle de scènes complexes. En conduite autonome, cette vision donne naissance à des modèles de monde de conduite — des simulateurs génératifs qui imaginent l’ego et le futur des agents, permettant une simulation évolutive, des tests sécuritaires de cas de coin et une richesse en génération de données synthétiques. Pourtant, malgré une croissance rapide de l’activité de recherche, le domaine manque d’un repère rigoureux pour mesurer les progrès et orienter les priorités. Les évaluations existantes demeurent limitées : les métriques vidéo génériques négligent les facteurs d’imagerie critiques pour la sécurité; la plausibilité de la trajectoire est rarement quantifiée; la cohérence temporelle et au niveau de l’agent est négligée; et la contrôlabilité par rapport au conditionnement de l’ego est ignorée. De plus, les ensembles de données actuels ne couvrent pas la diversité des conditions requises pour un déploiement dans le monde réel. Pour combler ces lacunes, nous présentons DrivingGen, la première référence complète pour les modèles mondiaux de conduite générative. DrivingGen combine un ensemble de données d’évaluation diversifié — sélectionné à la fois à partir de jeux de données de conduite et de sources vidéo à l’échelle d’Internet, couvrant des météos, des heures de la journée, des régions géographiques et des manœuvres complexes variées — avec une série de nouvelles métriques qui évaluent conjointement le réalisme visuel, la plausibilité de la trajectoire, la cohérence temporelle et la contrôlabilité. L’évaluation de 14 modèles à la fine pointe de la technologie révèle des compromis clairs : les modèles généraux sont plus beaux mais la physique des casseaux, tandis que ceux spécifiques à la conduite capturent le mouvement de façon réaliste mais ont du retard en qualité visuelle. DrivingGen offre un cadre d’évaluation unifié pour favoriser des modèles de conduite fiables, contrôlables et déployables, permettant une simulation évolutive, une planification et une prise de décision basée sur les données.

Keming Wu, Sicong Jiang, Max Ku, PING NIE, Minghao Liu, Wenhu Chen (membre du corps professoral de Vector)

Résumé :

Récemment, nous avons constaté de grands progrès dans le retouche d’images avec des instructions en langage naturel. Plusieurs modèles à code source fermé comme GPT-Image-1, Seedream et Google-Nano-Banana ont montré des progrès très prometteurs. Cependant, les modèles open source sont encore en retard. Le principal goulot d’étranglement est l’absence d’un modèle de récompense fiable pour mettre à l’échelle des données d’entraînement synthétiques de haute qualité. Pour remédier à ce goulot d’étranglement critique, nous avons construit EditReward, entraîné avec notre nouveau jeu de données de préférences humaines à grande échelle, méticuleusement annoté par des experts formés selon un protocole rigoureux contenant plus de 200 000 paires de préférences. EditReward démontre un alignement supérieur avec les préférences humaines dans les tâches d’édition d’images guidées par instructions. Des expériences montrent qu’EditReward atteint une corrélation humaine de pointe sur des benchmarks établis tels que GenAI-Bench, AURORA-Bench, ImagenHub et notre nouveau EditReward-Bench, surpassant une large gamme de modèles VLM en tant que juge. De plus, nous utilisons EditReward pour sélectionner un sous-ensemble de haute qualité à partir de l’ensemble de données ShareGPT-4o-Image déjà bruyant. Nous entraînons Step1X-Edit sur le sous-ensemble sélectionné, ce qui montre une amélioration significative par rapport à l’entraînement sur l’ensemble complet. Cela démontre la capacité d’EditReward à servir de modèle de récompense pour faire évoluer des données d’entraînement de haute qualité pour la retouche d’images. EditReward, avec son jeu de données d’entraînement, sera publié pour aider la communauté à bâtir davantage de jeux de données d’entraînement à l’édition d’images de haute qualité afin de rattraper les jeux de pointe.

TL; DR : Nous présentons EDITREWARD, entraîné sur EDITREWARD-DATA (200 000 paires de préférences humaines), et introduisons EDITREWARD-BENCH, établissant un nouvel état de l’art dans l’évaluation de l’édition d’images et la curation des données.

Raisonnement hiérarchique émergent dans les LLM grâce à l’apprentissage par renforcement

Haozhe Wang, Qixin Xu, Che Liu, Junhong Wu, Fangzhen Lin, Wenhu Chen (membre du corps professoral de Vector)

Résumé :

L’apprentissage par renforcement (RL) s’est avéré très efficace pour améliorer les capacités de raisonnement complexes des grands modèles de langage (LLM), mais les mécanismes sous-jacents à ce succès demeurent largement opaques. Notre analyse révèle que des phénomènes déroutants comme les « moments aha », « l’échelle de longueur » et la dynamique d’entropie ne sont pas des occurrences disparates, mais des marques d’une hiérarchie de raisonnement émergente, semblable à la séparation de la planification stratégique de haut niveau de l’exécution procédurale de bas niveau en cognition humaine. Nous découvrons une dynamique en deux phases convaincante : au départ, un modèle est limité par la correction procédurale et doit améliorer ses compétences de bas niveau. Le goulot d’étranglement d’apprentissage évolue alors de façon décisive, les gains de performance étant stimulés par l’exploration et la maîtrise de la planification stratégique de haut niveau. Cette analyse met en lumière une inefficacité fondamentale dans les algorithmes RL dominants comme le GRPO, qui appliquent une pression d’optimisation de façon agnostique et diluent le signal d’apprentissage sur tous les jetons. Pour y remédier, nous proposons l’Assignation de Crédit Consciente de la Hiérarchie (HICRA), un algorithme qui concentre les efforts d’optimisation sur des jetons de planification à fort impact. Nos expériences approfondies valident que l’HICRA surpasse nettement les références solides et offrent des perspectives approfondies sur la façon dont le raisonnement progresse à travers le prisme de l’exploration stratégique.

Jetons dynamiques guidés par entropie pour l’alignement graphe-LLM dans la compréhension moléculaire

Zihao Jing, Qiuhao Zeng, Ruiyi Fang, Yan Sun, Boyu Wang (affilié de la Faculté Vector), Pingzhao Hu

Résumé :

La compréhension moléculaire est centrale pour faire avancer des domaines tels que la découverte scientifique et pharmaceutique, mais les grands modèles de langage (LLM) ont du mal à comprendre efficacement les graphes moléculaires. Les ponts graphe–LLM existants adaptent souvent le connecteur de type Q-Former avec des jetons statiques à longueur fixe, qui est à l’origine conçu pour des tâches visuelles. Ces conceptions négligent la stéréochimie et le contexte sous-structurel et nécessitent généralement des ajustements coûteux de la dorsale LLM, limitant l’efficacité et la généralisation. Nous introduisons **EDT-Former**, un **D**ynamic **T**oken Trans*former** guidé par l’E**ntropy, qui génère des jetons alignés avec des patchs moléculaires informatifs, préservant ainsi les caractéristiques structurelles locales et globales pour la compréhension des graphes moléculaires. Au-delà des approches antérieures, EDT-Former permet l’alignement entre les encodeurs de graphes figés et les LLM sans ajuster la colonne vertébrale du LLM (à l’exception de la couche d’embarquement), ce qui permet un affinage efficace en calcul, et permet d’obtenir des résultats de pointe sur MoleculeQA, Mol-Instructions et benchmarks de prédiction de propriétés (TDC, MoleculeNet), soulignant son efficacité pour une compréhension moléculaire multimodale évolutive et généralisable.

TLDR : EDT-Former : jetons dynamiques de requête guidés par entropie mappent les graphes moléculaires vers les LLM, capturant les caractéristiques de structure locale et globale pour une compréhension et un raisonnement complets avec une formation sans infrastructure et uniquement connecteur.

Filippo Rinaldi, Aniello Panariello, Giacomo Salici, Fengyuan Liu, Marco Ciccone (boursier postdoctoral distingué Vector), Angelo Porrello, Simone Calderara

Résumé :

Lorsqu’une nouvelle version d’un modèle de fondation est publiée, les praticiens doivent généralement répéter l’ajustement complet, même si la même tâche a déjà été résolue dans la version précédente. Une alternative prometteuse est de réutiliser les changements de paramètres (c’est-à-dire les vecteurs de tâche) qui capturent comment un modèle s’adapte à une tâche spécifique. Cependant, ils ne parviennent souvent pas à se transférer entre différents modèles pré-entraînés en raison de leur espace de paramètres mal aligné. Dans ce travail, nous montrons que la clé du transfert réussi réside dans la structure de signes des gradients du nouveau modèle. Sur la base de cette idée, nous proposons GradFix, une méthode novatrice qui approxime la structure idéale du signe de gradient et l’utilise pour transférer des connaissances en utilisant seulement quelques échantillons étiquetés. Notamment, cela ne nécessite aucun ajustement fin supplémentaire : l’adaptation s’obtient en calculant quelques gradients au niveau du modèle cible et en masquant le vecteur de tâche source en conséquence. Cela donne une mise à jour localement alignée avec le paysage de perte cible, rebasant effectivement le vecteur de tâche sur le nouveau pré-entraînement. Nous offrons une garantie théorique que notre méthode assure une descente du premier ordre. Empiriquement, nous démontrons des gains de performance significatifs sur les benchmarks de vision et de langage, surpassant constamment l’addition naïve de vecteurs de tâches et l’ajustement fin de quelques coups.

TLDR : Le masquage à signe de gradient transfère des vecteurs de tâches entre les modèles de fondation avec peu d’échantillons, surpassant le transfert naïf et l’ajustement fin en quelques coups.

Adaptation homéostatique des codes optimaux de la population sous stress métabolique

Yi-Chun Hung, Gregory Schwartz (affilié du corps professoral Vector), Emily Cooper, Emma Alexander

Résumé :

Le traitement de l’information dans les populations neuronales est intrinsèquement contraint par les limites métaboliques des ressources et les propriétés du bruit, avec des dynamiques qui ne sont pas décrites avec précision par les modèles mathématiques existants. Des données récentes, par exemple, montrent que les neurones du cortex visuel de la souris entrent en « mode faible consommation » dans lequel ils maintiennent une homéostasie du taux de tir tout en dépensant moins d’énergie. Cette adaptation entraîne une augmentation du bruit neuronal et un aplatissement de la courbe d’accordage en réponse au stress métabolique. Nous avons développé un cadre théorique de codage des populations qui capture ce comportement en utilisant deux contraintes nouvelles, étonnamment simples : une approximation de l’homéostasie du taux de tir et une limite d’énergie liée aux niveaux de bruit via simulation biophysique. Une caractéristique clé de notre contribution est un modèle de bilan énergétique reliant directement l’utilisation d’adénosine triphosphate (ATP) dans les cellules à un cadre mathématique entièrement explicable qui généralise les codes de population optimaux existants. Plus précisément, notre simulation fournit un modèle de bruit de Poisson dispersé dépendant de l’énergie, basé sur l’hypothèse que la cellule suivra un chemin de désintégration optimal pour produire le taux de pic le moins bruyant possible à un budget énergétique cellulaire donné. Chaque état le long de ce parcours optimal est associé à des propriétés (potentiel de repos et conductance de fuite) qui peuvent être mesurées dans des expériences d’électrophysiologie et qui ont montré qu’elles changent sous une privation calorique prolongée. Nous dérivons analytiquement la stratégie de codage optimale pour les neurones sous différents budgets énergétiques et objectifs de codage, et montrons comment notre méthode capture de manière unique comment les populations de courbes d’accordage s’adaptent tout en maintenant l’homéostasie, comme cela a été observé empiriquement.

Samin Mahdizadeh Sani, Max Ku, Nima Jamali, Matina Sani, Paria Khoshtab, Wei-Chieh Sun, Parnian Fazel, Zhi Rui Tam, Thomas Chong, Edisy Kin Wai Chan, Donald Tsang, Chiao-Wei Hsu, Ting Lam, Ho Ng, Chiafeng Chu, Chak-Wing Mak, Keming Wu, Wong Hiu-Tung, Yik Ho, Chi Ruan, Zhuofeng Li, I-Sheng Fang, Shih-Ying Yeh, Ho Kei Cheng, Ping Nie, Wenhu Chen (membre du corps professoral de Vector)

Résumé :

Advances in diffusion, autoregressive, and hybrid models have enabled high-quality image synthesis for tasks such as text-to-image, editing, and reference-guided composition. Yet, existing benchmarks remain limited, either focus on isolated tasks, cover only narrow domains, or provide opaque scores without explaining failure modes. We introduce \textbf{ImagenWorld}, a benchmark of 3.6K condition sets spanning six core tasks (generation and editing, with single or multiple references) and six topical domains (artworks, photorealistic images, information graphics, textual graphics, computer graphics, and screenshots). The benchmark is supported by 20K fine-grained human annotations and an explainable evaluation schema that tags localized object-level and segment-level errors, complementing automated VLM-based metrics. Our large-scale evaluation of 14 models yields several insights: (1) models typically struggle more in editing tasks than in generation tasks, especially in local edits. (2) models excel in artistic and photorealistic settings but struggle with symbolic and text-heavy domains such as screenshots and information graphics. (3) closed-source systems lead overall, while targeted data curation (e.g., Qwen-Image) narrows the gap in text-heavy cases. (4) modern VLM-based metrics achieve Kendall accuracies up to 0.79, approximating human ranking, but fall short of fine-grained, explainable error attribution. ImagenWorld provides both a rigorous benchmark and a diagnostic tool to advance robust image generation.

Tomas Tokar, Scott Sanner (affilié du corps professoral Vector)

Résumé :

Les ensembles représentent une abstraction fondamentale à travers de nombreux types de données. Pour gérer la nature non ordonnée des données structurées par ensembles, des modèles comme DeepSets et PointNet reposent sur des opérations de mise en commun fixes et non apprenables (par exemple, somme ou maximum) — un choix de conception qui peut freiner la transférabilité des embeddings appris et limiter l’expressivité du modèle. Plus récemment, des fonctions d’agrégation apprenables ont été proposées comme alternatives plus expressives. Dans ce travail, nous faisons progresser cette ligne de recherche en introduisant la moyenne de Kolmogorov neuralisée (NKM) — un cadre novateur et entraînable pour apprendre une mesure généralisée de la tendance centrale via une fonction neuronale inversible. Nous proposons également des réseaux de neurones quasi-arithmétiques (QUANN), qui intègrent le NKM comme fonction d’agrégation apprenable. Nous fournissons une analyse théorique montrant que les QUANN sont des approximateurs universels pour une large classe de décompositions courantes en fonctions d’ensembles et, grâce à leurs composantes neuronales inversibles, apprennent des représentations latentes plus structurées. Empiriquement, les QUANN surpassent les bases de pointe à travers divers benchmarks, tout en apprenant des embeddings qui se transposent efficacement même aux tâches qui n’impliquent pas d’ensembles.

TL; DR : Nous introduisons des réseaux de neurones quasi-arithmétiques (QUANN), qui utilisent la moyenne de Kolmogorov neuralisée — un mécanisme de pooling entraînable nouvellement introduit — pour améliorer l’approximation des fonctions d’ensemble.

Wei Liu, Ruochen Zhou, Yiyun Deng, Yuzhen Huang, Junteng Liu, Yuntian Deng (affilié de la faculté vectoriel), Yizhe Zhang, Junxian He

Résumé :

Les grands modèles de raisonnement (LRM) ont démontré des capacités remarquables à résoudre des problèmes complexes par apprentissage par renforcement (RL), notamment en générant de longues traces de raisonnement. Cependant, ces sorties étendues présentent souvent une redondance importante, ce qui limite l’efficacité des LRM. Dans cet article, nous étudions les approches basées sur le RL pour promouvoir l’efficacité du raisonnement. Plus précisément, nous présentons d’abord un cadre unifié qui formule diverses méthodes de raisonnement efficaces à travers le prisme de la mise en forme de la récompense basée sur la longueur. En s’appuyant sur cette perspective, nous proposons une nouvelle méthode de mise en forme de l’axe (LASER) de type **L**ength-b**A**Seded **S**t**E**E**p, qui utilise une fonction pas comme récompense basée sur la longueur de la cible. LASER surpasse les méthodes précédentes, offrant un meilleur compromis entre performance et efficacité. Ensuite, nous étendons LASER sur la base de deux intuitions clés : (1) Le comportement de raisonnement du modèle évolue dynamiquement pendant l’entraînement, nécessitant des spécifications de récompense qui sont aussi adaptatives et dynamiques; (2) Plutôt que d’encourager uniformément des chaînes de pensée plus courtes ou plus longues (CoT), nous postulons que la mise en forme de la récompense basée sur la longueur devrait être consciente de la difficulté, c’est-à-dire qu’elle devrait pénaliser davantage les CoT longs pour les requêtes faciles. Cette approche devrait faciliter une combinaison de pensée rapide et lente, menant à un meilleur compromis global. La méthode résultante est appelée LASER-D (**D**ynamic et **D**ifficulty-aware). Des expériences sur cinq modèles à poids ouvert allant de 1,5B à 32B démontrent que notre approche améliore significativement à la fois la performance de raisonnement et l’efficacité de la longueur de réponse. Par exemple, LASER-D obtient une amélioration de **5,3** sur AIME2024 tout en réduisant l’utilisation des jetons de **64**%. Une analyse plus poussée révèle que notre compression basée sur le RL produit des motifs de raisonnement plus concis avec moins d'« auto-réflexions » redondantes.

LogicXGNN : Règles logiques fondées pour expliquer les réseaux neuronaux à graphes

Chuqin Geng, Ziyu Zhao, Zhaoyue Wang, Haolin Ye, Yuhe Jiang, Xujie Si (affiliée de la faculté vectoriel)

Résumé :

Les explications existantes basées sur des règles pour les réseaux neuronaux à graphes (GNN) offrent une interprétabilité globale, mais optimisent et évaluent souvent la fidélité dans un espace conceptuel intermédiaire et ininterprétable, négligeant la qualité de mise à la terre des explications finales du sous-graphe pour les utilisateurs finaux. Cet écart donne des explications qui peuvent sembler fidèles mais peu fiables en pratique. À cette fin, nous proposons LogicXGNN, un cadre post hoc qui construit des règles logiques sur des prédicats fiables explicitement conçus pour capturer la structure de transmission de messages du GNN, assurant ainsi une mise à la terre efficace. Nous introduisons également la fidélité fondée sur les données ($Fid_D$), une métrique réaliste qui évalue les explications sous forme de graphe final, ainsi que des métriques d’utilité complémentaires telles que la couverture et la validité. À travers de nombreuses expériences, LogicXGNN améliore $Fid_D$ de plus de 20% en moyenne par rapport aux méthodes de pointe, tout en étant 10 à 100 fois plus rapide. Avec une forte scalabilité et des performances utilitaires, LogicXGNN produit des explications fidèles à la logique du modèle et fondées de manière fiable sur des données observables.

Ahmadreza Jeddi, Marco Ciccone (chercheur postdoctoral distingué Vector), Babak Taati (affilié à la faculté Vector)

Résumé :

Les Transformers en boucle sont devenus une classe de modèles efficaces et puissants pour le raisonnement dans le domaine du langage. Des études récentes montrent que ces modèles obtiennent de fortes performances sur les tâches algorithmiques et de raisonnement, suggérant que les architectures bouclées présentent un biais inductif en faveur du raisonnement latent. Cependant, les approches antérieures fixent le nombre d’itérations de boucles pendant l’entraînement et l’inférence, laissant ouverte la question de savoir si ces modèles peuvent adapter de manière flexible leur profondeur de calcul sous des budgets de calcul variables. Nous introduisons LoopFormer, un Transformer bouclé entraîné sur des trajectoires de longueur variable pour permettre un raisonnement conditionné au budget. Notre contribution principale est un schéma d’entraînement de raccourci et de cohérence qui aligne des trajectoires de différentes longueurs, assurant que les boucles plus courtes produisent des représentations informatives tandis que les boucles plus longues continuent de les affiner. Boucle Former conditionne chaque boucle selon le temps et la taille de pas actuels, permettant aux représentations d’évoluer de manière cohérente sur des trajectoires de longueurs variables plutôt que de dériver ou de stagner. Empiriquement, LoopFormer démontre des performances robustes sur la modélisation du langage et les benchmarks de raisonnement même sous contraintes de calcul agressives, tout en évoluant harmonieusement avec un budget supplémentaire. Ces résultats montrent que les Transformers en boucle sont intrinsèquement adaptés à la modélisation adaptative du langage, ouvrant la voie à des grands modèles de langage contrôlables et adaptés au budget.

Lyra : Reconstruction générative 3D de scènes via l’auto-distillation du modèle de diffusion vidéo

Sherwin Bahmani, Tianchang Shen, Jiawei Ren, Jiahui Huang, Yifeng Jiang, Haithem Turki, Andrea Tagliasacchi, David Lindell (affilié à la faculté Vector), Zan Gojcic, Sanja Fidler (membre du corps professoral Vector), Huan Ling, Jun Gao, Xuanchi Ren

Résumé :

La capacité à générer des environnements virtuels est cruciale pour des applications allant du jeu vidéo aux domaines physiques de l’IA tels que la robotique, la conduite autonome et l’IA industrielle. Les méthodes actuelles de reconstruction 3D basées sur l’apprentissage reposent sur la disponibilité de données multi-vues réelles capturées, ce qui n’est pas toujours facilement disponible. Les avancées récentes dans les modèles de diffusion vidéo ont démontré des capacités d’imagination remarquables, mais leur nature 2D limite les applications à la simulation où un robot doit naviguer et interagir avec l’environnement. Dans cet article, nous proposons un cadre d’auto-distillation visant à distiller les connaissances 3D implicites dans les modèles de diffusion vidéo en une représentation explicite du splatting gaussienne 3D (3DGS), éliminant ainsi le besoin de données d’entraînement multi-vues. Plus précisément, nous complançons le décodeur RGB typique avec un décodeur 3DGS, supervisé par la sortie du décodeur RGB. Dans cette approche, le décodeur 3DGS peut être entraîné uniquement avec des données synthétiques générées par des modèles de diffusion vidéo. Au moment de l’inférence, notre modèle peut synthétiser des scènes 3D soit à partir d’une invite textuelle, soit d’une seule image pour un rendu en temps réel. Notre cadre s’étend aussi à la génération dynamique de scènes 3D à partir d’une vidéo d’entrée monoculaire. Les résultats expérimentaux démontrent que notre cadre atteint des performances de pointe dans la génération de scènes 3D statiques et dynamiques. Résultats vidéo : https://anonlyra.github.io/anonlyra

TL; DR : 3D et 4D à avance directe avec modèles de diffusion vidéo contrôlés par la caméra

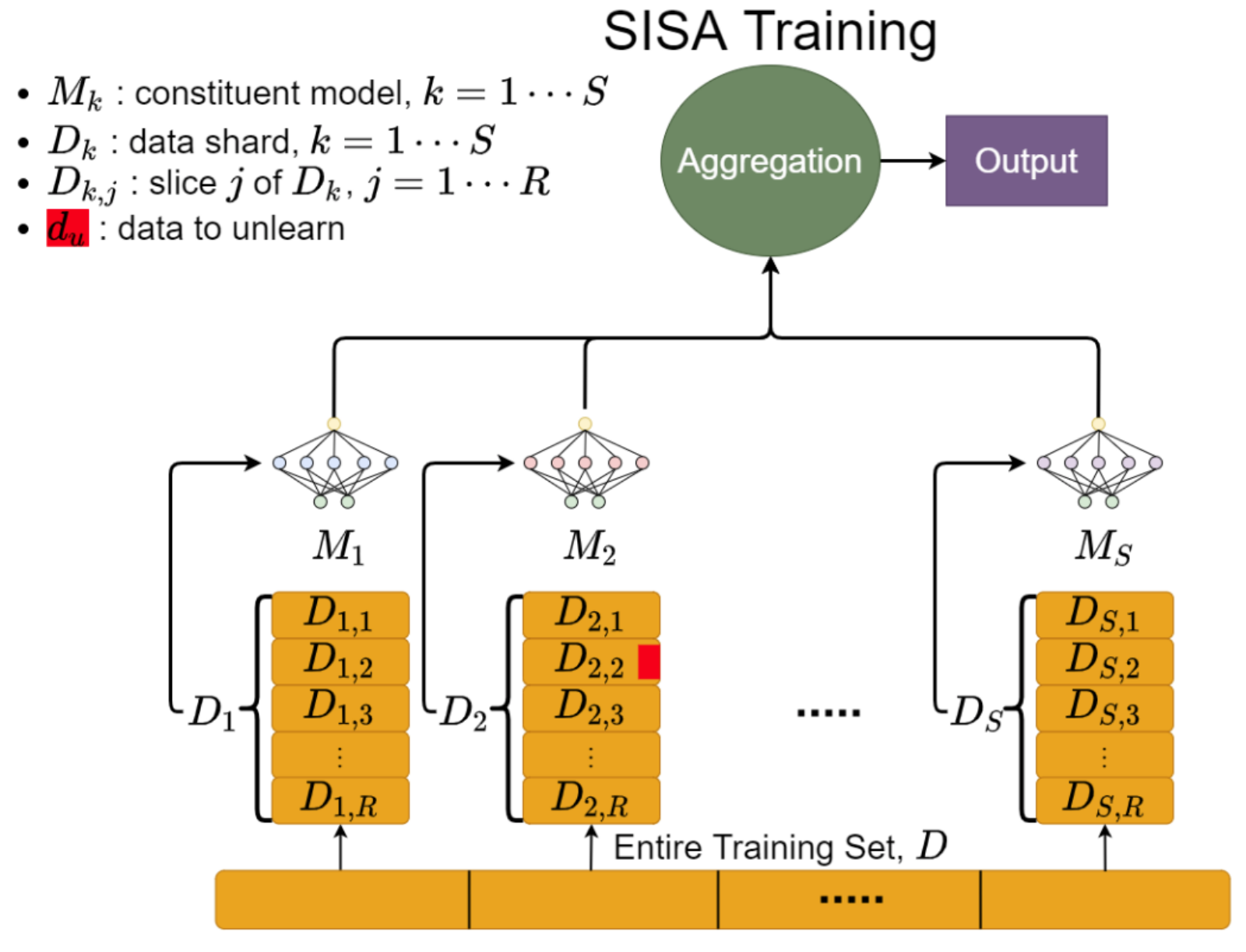

Atténuer les risques pour la vie privée en oubliant un désapprentissage sans réglage

Aviraj Newatia, Michael Cooper, Viet Nguyen, Rahul G. Krishnan (membre du corps professoral de Vector)

Résumé :

Training machine learning models requires the storage of large datasets, which often contain sensitive or private data. Storing data is associated with a number of potential risks which increase over time, such as database breaches and malicious adversaries. Machine unlearning is the study of methods to efficiently remove the influence of training data subsets from previously-trained models. Existing unlearning methods typically require direct access to the “forget set”—the data to be forgotten-and organisations must retain this data for unlearning rather than deleting it immediately upon request, increasing risks associated with the forget set. We introduce partially-blind unlearning—utilizing auxiliary information to unlearn without explicit access to the forget set. We introduce a practical framework Reload, a partially-blind method based on gradient optimization and structured weight sparsification to operationalize partially-blind unlearning. We show that Reload efficiently unlearns, approximating models retrained from scratch, and outperforms several forget set-dependent approaches. On language models, Reload unlearns entities using <0.025\% of the retain set and <7\% of model weights in <8 minutes on Llama2-7B. In the corrective case, Reload achieves unlearning even when only 10\% of corrupted data is identified.

Xiaotian Liu, Armin Toroghi, Jiazhou Liang, David Courtis, Ruiwen Li, Ali Pesaranghader, Jaehong Kim, Tanmana Sadhu, Hyejeong Jeon, Scott Sanner (affilié de la faculté Vector)

Résumé :

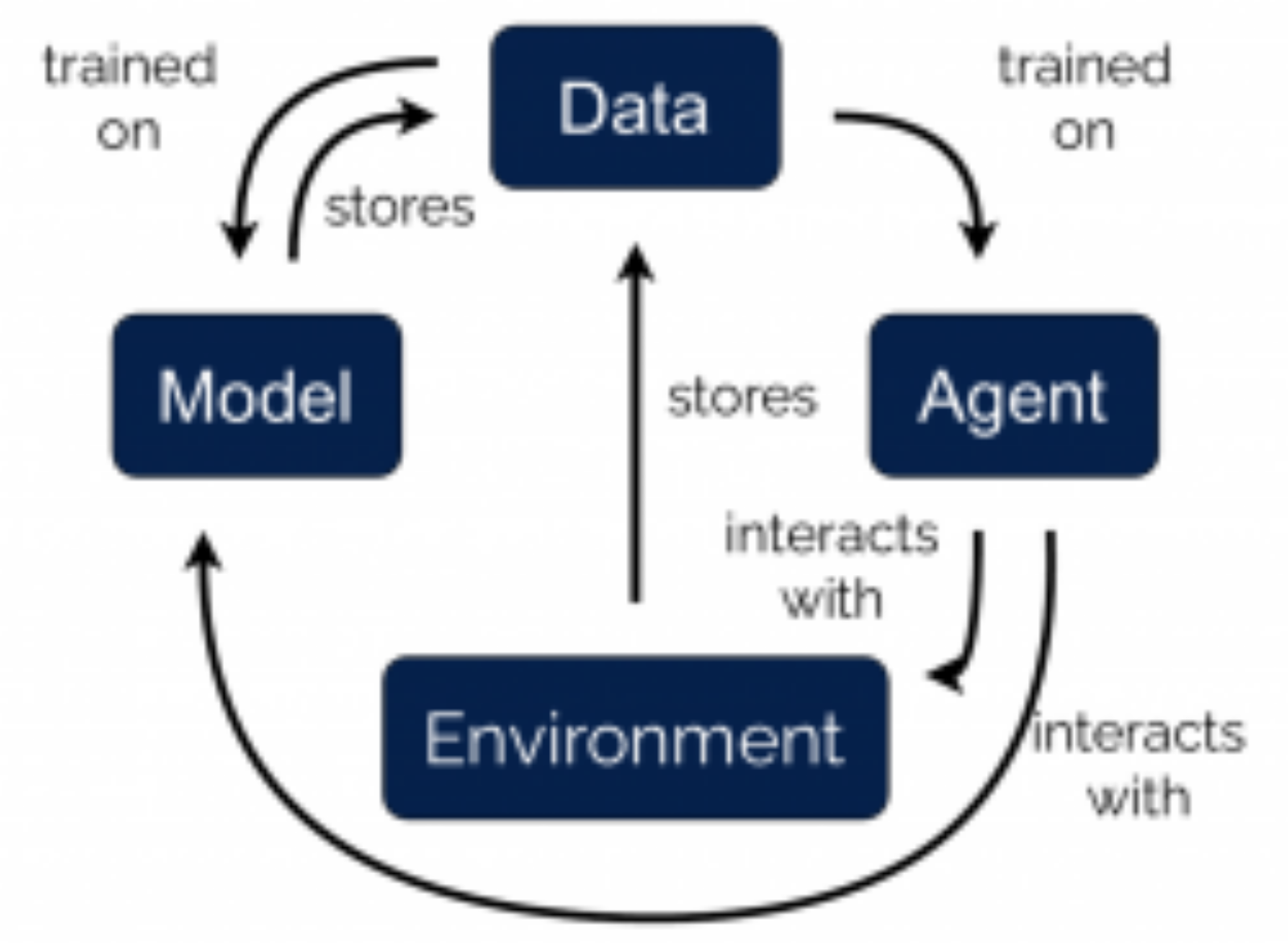

La planification dans des environnements en monde ouvert, où les agents doivent agir avec des états partiellement observés et des connaissances incomplètes, est un défi central en IA incarnée. La planification en monde ouvert implique non seulement de séquençar les actions, mais aussi de déterminer quelles informations l’agent doit détecter pour permettre ces actions. Les approches existantes utilisant les grands modèles de langage (LLM) et les modèles vision-langage (VLM) ne peuvent pas planifier de manière fiable sur des horizons longs et des objectifs complexes, où elles hallucinent souvent et ne raisonnent pas de manière causale sur les interactions agent-environnement. Alternativement, les planificateurs PDDL classiques offrent un raisonnement correct et de principe, mais échouent dans les contextes en monde ouvert : ils présupposent des modèles complets et dépendent d’un fondement exhaustif sur tous les objets, états et actions; ils ne peuvent pas corriger le désalignement entre les spécifications d’objectif (par exemple, « chauffer le pain ») et celles d’action (par exemple, « griller le pain »); et ils ne généralisent pas entre différentes modalités (par exemple, texte, vision). Pour relever ces défis fondamentaux : (i) nous étendons la PDDL symbolique en une représentation flexible en langage naturel que nous appelons NL-PDDL, améliorant l’accessibilité pour les utilisateurs non experts ainsi que la généralisation des modalités; (ii) nous généralisons la planification de type régression à NL-PDDL avec un raisonnement par implication de bon sens afin de déterminer ce qui doit être observé pour atteindre les objectifs dans des environnements partiellement observés avec un désalignement potentiel de spécification objectif-action; et (iii) nous utilisons la spécification allégée de NL-PDDL pour faciliter une planification en monde ouvert qui évite une mise à la terre exhaustive et offre une complexité temporelle et spatiale indépendante du nombre d’objets, d’états et d’actions au sol. Nos expériences dans trois domaines divers — le Blocksworld classique et l’environnement incarné ALFWorld avec des états textuels et visuels — montrent que NL-PDDL surpasse largement les bases existantes, est plus robuste face à des horizons plus larges et des objectifs plus complexes, et se généralise entre différentes modalités.

NeuralOS : Vers la simulation des systèmes d’exploitation via des modèles génératifs neuronaux

Luke Rivard, Sun Sun, Hongyu Guo, Wenhu Chen (membre du corps professoral Vector), Yuntian Deng (affilié du corps professoral Vector)

Résumé :

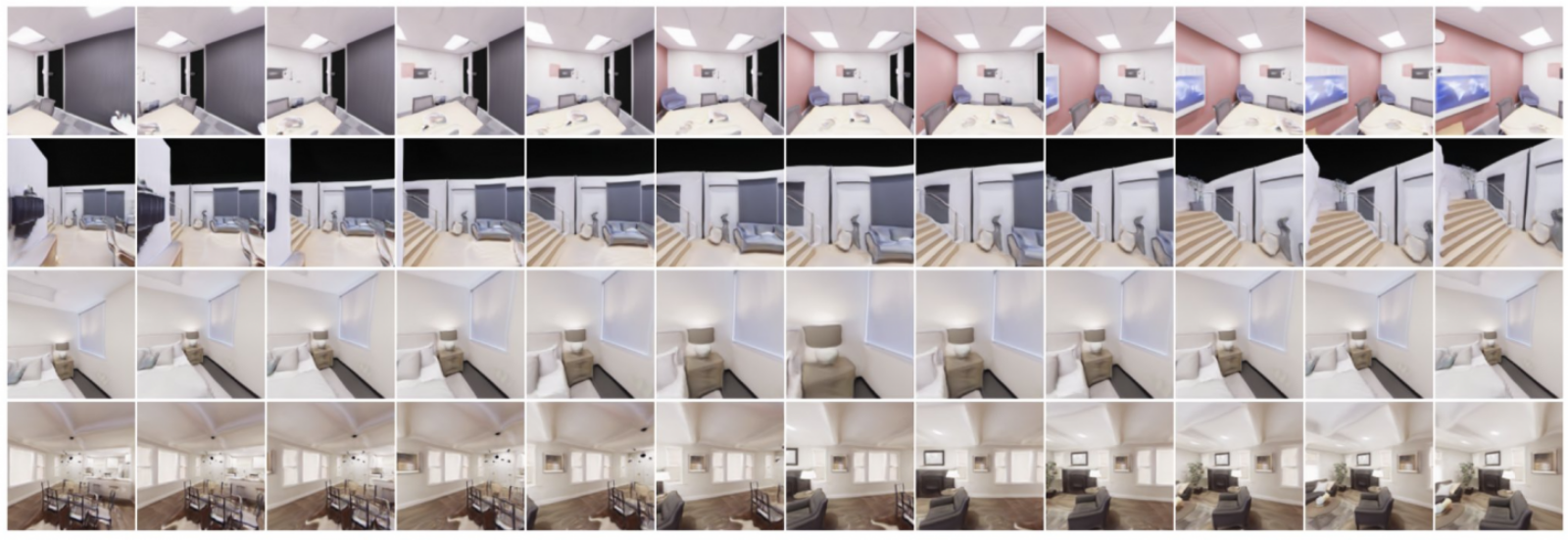

Nous introduisons NeuralOS, un cadre neuronal qui simule les interfaces graphiques utilisateur (GUI) des systèmes d’exploitation en prédisant directement les images d’écran en réponse aux entrées de l’utilisateur telles que les mouvements de souris, les clics et les événements clavier. NeuralOS combine un réseau neuronal récurrent (RNN), qui suit l’état de l’ordinateur, avec un moteur de rendu neuronal basé sur la diffusion qui génère des images à l’écran. Le modèle est entraîné sur un ensemble de données d’enregistrements XFCE d’Ubuntu, qui incluent à la fois des interactions générées aléatoirement et des interactions réalistes produites par des agents IA. Des expériences démontrent que NeuralOS rend avec succès des séquences GUI réalistes, capture avec précision les interactions avec la souris et prédit de manière fiable les transitions d’état comme les lancements d’applications. Au-delà de la reproduction des systèmes existants, NeuralOS montre que les données d’entraînement synthétisées peuvent apprendre au modèle à simuler des applications qui n’ont jamais été installées, comme l’illustre une application Doom, et suggère une voie vers l’apprentissage des interfaces utilisateur uniquement à partir de démonstrations synthétiques.

TL; DR : Nous introduisons un modèle de génération neuronale qui simule les interfaces des systèmes d’exploitation en générant directement des images d’écran à partir des entrées de l’utilisateur.

Optimisation privée à taux contraint avec applications à un apprentissage équitable

Mohammad Yaghini, Tudor Cebere, Michael Menart, Aurélien Bellet, Nicolas Papernot (membre du corps professoral Vector)

Résumé :

De nombreux problèmes en apprentissage automatique fiable peuvent s’exprimer comme des contraintes sur les taux de prédiction entre sous-populations, y compris les contraintes d’équité des groupes (parité démographique, cotes égalisées, etc.). Dans ce travail, nous étudions ces problèmes de minimisation contrainte dans le cadre de la confidentialité différentielle (DP). Les techniques standard d’optimisation DP comme DP-SGD reposent sur des objectifs qui se décomposent sur des exemples individuels, permettant ainsi le dégradé par exemple et l’ajout de bruit. Les contraintes de taux dépendent toutefois des statistiques agrégées entre groupes, créant des dépendances inter-échantillons qui violent cette décomposabilité. Pour y remédier, nous développons RaCO-DP, une variante DP de la descente-ascension en gradient stochastique (SGDA) qui résout la formulation lagrangienne des problèmes de contrainte de taux. Nous montrons que le coût supplémentaire en matière de confidentialité lié à l’intégration de ces contraintes réduit à une estimation privée d’un histogramme sur le mini-lot à chaque étape. Nous démontrons la convergence de notre algorithme grâce à une nouvelle analyse de SGDA qui exploite la structure linéaire du paramètre dual. Les résultats empiriques montrent que notre méthode domine les approches d’apprentissage privé existantes sous contraintes d’équité de groupe et atteint également une forte performance en termes de confidentialité, d’utilité et d’équité sur les réseaux de neurones.

Co-optimisation des prompts et paramètres pour les grands modèles de langage

Xiaohe Bo, Rui Li, Zexu Sun, Quanyu Dai, Zeyu Zhang, Zihang Tian, Xu Chen (boursier postdoctoral Schmidt AI en sciences), Zhenhua Dong

Résumé :

L’optimisation des prompts et l’ajustement fin sont deux approches majeures pour améliorer la performance des grands modèles de langage (LLM). Ils améliorent les capacités des LLM sous des perspectives complémentaires : les premières par un langage naturel explicite, les secondes par des mises à jour implicites des paramètres. Cependant, les travaux antérieurs les ont généralement étudiés isolément, laissant leur potentiel synergique largement sous-exploré. Pour combler ce fossé, dans cet article, nous introduisons MetaTuner, un cadre novateur qui intègre conjointement l’optimisation des prompts et l’ajustement fin pour la formation en LLM. Plus précisément, nous introduisons deux réseaux de neurones pour générer respectivement des prompts et des paramètres, tout en leur permettant de partager une couche d’encodage inférieure commune pour permettre le partage des connaissances. Grâce à la guidance des signaux supervisés finaux, notre cadre est optimisé pour découvrir les combinaisons optimales entre les prompts et les paramètres. Étant donné que l’apprentissage par prompts implique une optimisation discrète tandis que l’ajustement fin fonctionne dans un espace de paramètres continu, nous concevons une perte de régularisation supervisée pour entraîner efficacement notre cadre. Des expériences approfondies à travers divers benchmarks montrent que notre méthode surpasse constamment les références. Pour le bénéfice de la communauté de recherche, nous avons lancé notre projet à https://anonymous.4open.science/r/metatuner.

TLDR : Cet article propose MetaTuner, un cadre novateur qui optimise conjointement les prompts et les paramètres des LLM grâce à un mécanisme de partage de connaissances et une perte de régularisation supervisée, obtenant ainsi des performances supérieures sur plusieurs benchmarks.

Optimisation des politiques par chemin par chemin par entropie relative

Claas Voelcker, Axel Brunnbauer, Marcel Hussing, Michal Nauman, Pieter Abbeel, Radu Grosu, Eric Eaton, Amir-Massoud Farahmand, Igor Gilitschenski (membre du corps professoral de Vector)

Résumé :

Les méthodes basées sur les scores-fonction pour l’apprentissage des politiques, telles que REINFORCE et PPO, ont donné de solides résultats en jeu et en robotique, mais leur forte variabilité nuit souvent à la stabilité de la formation. L’utilisation de gradients de politique par chemin, c’est-à-dire le calcul d’une dérivée en différenciant la fonction objectif, atténue les problèmes de variance. Cependant, ils nécessitent une fonction de valeur conditionnée par une action précise, notoirement difficile à apprendre sans dépendre des tampons de replay pour réutiliser les données hors politique passées. Nous présentons un algorithme on-policy qui entraîne les modèles Q-value uniquement à partir de trajectoires on-policy, ouvrant ainsi la possibilité d’utiliser des mises à jour de politiques par chemin dans le contexte de l’apprentissage on-policy. Nous montrons comment combiner des politiques stochastiques pour l’exploration avec des mises à jour contraintes pour un entraînement stable, et évaluons les composants architecturaux importants qui stabilisent l’apprentissage de la fonction de valeur. Le résultat, Relative Entropy Path Policy Optimization (REPPO), est un algorithme on-policy efficace qui combine la stabilité des gradients de politique path à path avec la simplicité et la minimalité de l’empreinte mémoire de l’apprentissage on-policy standard. Comparé à l’état de l’art sur deux benchmarks standard paralléllisés par GPU, REPPO offre de fortes performances empiriques avec une efficacité d’échantillonnage supérieure, un temps d’horloge murale, une empreinte mémoire et une robustesse des hyperparamètres.

TLDR : REPPO utilise l’estimation du gradient direct via une fonction Q de substitution pour obtenir des gradients de politique plus précis.

SANA-Video : Génération vidéo efficace avec transformateur de diffusion linéaire à blocs

Junsong Chen, Yuyang Zhao, Jincheng YU, Ruihang Chu, Junyu Chen, Shuai Yang, Xianbang Wang, Yicheng Pan, Zhou Daquan, Huan Ling, Haozhe Liu, Hongwei Yi, Hao Zhang, Muyang Li, Yukang Chen, Han Cai, Sanja Fidler (membre du corps professoral de Vector), Ping Luo, Song Han, Enze Xie

Résumé :

Nous introduisons SANA-Video, un modèle de petite diffusion capable de générer efficacement des vidéos jusqu’à une résolution de 720×1280 et une durée d’une minute. SANA-Video synthétise des vidéos longue et haute résolution, de haute qualité avec un fort alignement texte-vidéo à une vitesse remarquablement rapide, déployable sur GPU RTX 5090. Deux conceptions principales assurent notre génération vidéo efficace, efficace et longue : (1) DiT linéaire : Nous exploitons l’attention linéaire comme opération principale, ce qui est plus efficace que l’attention vanilla compte tenu du grand nombre de jetons traités lors de la génération vidéo. (2) Cache KV à mémoire constante pour l’attention linéaire par blocs : nous concevons une approche autorégressive bloc par bloc pour la génération vidéo longue en employant un état mémoire constante, dérivé des propriétés cumulatives de l’attention linéaire. Ce cache KV fournit au DiT linéaire un contexte global à un coût mémoire fixe, éliminant le besoin d’un cache KV traditionnel et permettant une génération vidéo efficace d’une minute. De plus, nous explorons des filtres de données efficaces et des stratégies d’entraînement de modèles, réduisant le coût d’entraînement à 12 jours sur 64 GPU H100, ce qui ne représente que 1\% du coût de MovieGen. Compte tenu de son faible coût, SANA-Video atteint des performances compétitives comparées aux modèles modernes à petite diffusion à la fine pointe de la technologie (par exemple, Wan 2.1-1.3B et SkyReel-V2-1.3B) tout en étant 16 fois plus rapide en latence mesurée. De plus, SANA-Video peut être déployé sur des GPU RTX 5090 avec une précision NVFP4, accélérant la vitesse d’inférence générant une vidéo 720p de 5 secondes de 71 secondes à 29 secondes (2,4x) de vitesse. En résumé, SANA-Video permet une génération vidéo de haute qualité à faible coût. Le code et le modèle seront rendus publics.

Ruiyi Fang, Jingyu Zhao, Shuo Wang, Ruizhi Pu, Bingheng Li, Jiale Cai, Zhihao Li, Zihao Jing, Jian Zhu, Song Tang, Charles Ling (ancien affilié de la faculté Vector), Boyu Wang (affilié de la faculté Vector)

Résumé :

L’adaptation du domaine des graphes (GDA) transfère les connaissances d’un graphe source identifié vers un graphe cible non étiqueté afin d’atténuer la rareté des étiquettes. Dans les graphiques multi-vues, le défi d’atténuer le décalage de domaine est limité par l’information structurelle à travers différentes vues. De plus, dans chaque vue, les structures situées à différents houblonnages capturent des niveaux de voisinage distincts, ce qui peut entraîner des divergences structurelles variables. Cependant, les méthodes existantes supposent généralement une structure de graphe à vue unique, ce qui ne peut pas capturer efficacement la richesse des informations structurelles dans les graphes multirelationnels et nuit aux performances d’adaptation. Dans cet article, nous abordons le problème complexe de l’adaptation multi-vue du domaine des graphes (MGDA) en proposant l’alignement guidé par agrégation structurelle (SAGA) qui aligne les données de graphes multi-vues via la sélection dynamique des vues et de l’ordre des voisinages. Plus précisément, nous proposons la notion de distance d’agrégation structurelle (SAD) comme une métrique dynamique de disparrepance qui considère conjointement l’ordre de la vue et du voisinage, permettant à la paire dominante vue–ordre de varier pendant l’entraînement. Par l’analyse empirique, nous justifions la validité du SAD et montrons que la divergence de domaine dans le MGDA est largement gouvernée par la paire dominante vision–ordre, qui évolue tout au long de l’entraînement. Motivés par cette observation, nous concevons SAGA, qui exploite SAD pour identifier dynamiquement la paire principale d’ordre de vue qui guide l’alignement, caractérisant ainsi et atténuant efficacement les écarts structurels au niveau de la vue et du saut entre les graphes multi-vues. Les résultats expérimentaux sur divers benchmarks de graphes multirelationnels vérifient l’efficacité de notre méthode.

Diffusion SE(3) spatio-temporelle évolutive pour la dynamique des protéines à long horizon

Nima Shoghi, Yuxuan Liu, Yuning Shen, Rob Brekelmans (ancien boursier postdoctoral distingué Vector), Pan Li, Quanquan Gu

Résumé :

Les simulations de dynamique moléculaire (MD) demeurent la référence pour l’étude de la dynamique des protéines, mais leur coût computationnel limite l’accès à des échelles de temps biologiquement pertinentes. Les modèles génératifs récents ont montré du potentiel dans l’accélération des simulations, mais ils peinent à générer à long horizon en raison de contraintes architecturales, d’accumulation d’erreurs et d’une modélisation inadéquate de la dynamique spatio-temporelle. Nous présentons STAR-MD (Spatio-Temporal Autoregressive Rollout for Molecular Dynamics), un modèle de diffusion SE(3)-équivariant évolutif qui génère des trajectoires protéiques physiquement plausibles sur des échelles de temps de microsecondes. Notre innovation clé est un transformateur de diffusion causal avec une attention spatio-temporelle conjointe qui capture efficacement les dépendances complexes de l’espace-temps tout en évitant les goulots d’étranglement mémoire des méthodes existantes. Sur la référence standard ATLAS, STAR-MD atteint des performances de pointe sur toutes les mesures – améliorant considérablement la couverture conformationnelle, la validité structurelle et la fidélité dynamique par rapport aux méthodes précédentes. STAR-MD extrapole avec succès pour générer des trajectoires stables à l’échelle de la microseconde où les méthodes de base échouent de façon catastrophique, maintenant une haute qualité structurelle tout au long du déploiement prolongé. Notre évaluation complète révèle de graves limites dans les modèles actuels de génération à long horizon, tout en démontrant que la modélisation spatiotemporale conjointe de STAR-MD permet une simulation dynamique robuste à des échelles de temps biologiquement pertinentes, ouvrant la voie à une exploration accélérée de la fonction des protéines.

TLDR : Un modèle évolutif de diffusion spatiotemporale SE(3) qui génère des trajectoires protéiques à long horizon avec une fidélité de pointe.

SPIKE-RL : Les vidéo-LLM rencontrent la surprise bayésienne

Sahithya Ravi, Aditya Chinchure, Raymond Ng, Leonid Sigal (membre du corps professoral Vector), Vered Shwartz (membre du corps professoral Vector)

Résumé :

Les vidéos du monde réel montrent souvent des activités routinières ponctuées d’événements mémorables et surprenants. Cependant, la plupart des Video-LLM traitent les vidéos en échantillonnant les images de façon uniforme, manquant probablement les moments critiques qui définissent la narration d’une vidéo. Nous introduisons SPIKE, un cadre d’inférence-temps qui quantifie la surprise bayésienne comme la mise à jour des croyances déclenchée par de nouvelles preuves visuelles dans le flux vidéo, identifiant les moments où de nouvelles preuves visuelles entrent en conflit avec les croyances antérieures. SPIKE localise efficacement la surprise dans les vidéos, corrélée aux humains sur des benchmarks positifs (FunQA) et négatifs (Oups!) surprise. SPIKE-RL améliore encore sa capacité à détecter la surprise, utilisant GRPO pour affiner ses hypothèses de croyance basées sur un signal de récompense issu de la légende vidéo. SPIKE et SPIKE-RL guident l’échantillonnage d’images surprise, indépendant de la requête, qui attribue plus d’images à des moments intéressants de la vidéo. Avec cette stratégie, nous obtenons des gains de performance constants sur cinq benchmarks en aval. En permettant aux Video-LLM de suivre leurs croyances et d’exprimer la surprise, notre travail ouvre la voie à des modèles plus robustes capables de réviser leur compréhension en réponse à de nouvelles informations.

TL; DR : Nous rendons les Video-LLM sensibles à la surprise en suivant les changements de croyances dans les vidéos.

StreamSplat : Vers une reconstruction 3D dynamique en ligne à partir de flux vidéo non calibrés

Zike Wu, Qi Yan, Xuanyu Yi, Lele Wang, Renjie Liao (membre du corps professoral de Vector)

Résumé :

La reconstruction en temps réel de scènes 3D dynamiques à partir de flux vidéo non calibrés exige des méthodes en ligne robustes qui récupèrent la dynamique des scènes à partir d’observations clairsemées sous des contraintes strictes de latence et de mémoire. Pourtant, la plupart des méthodes de reconstruction dynamique reposent sur des heures d’optimisation par scène sous accès à la séquence complète, limitant le déploiement pratique. Dans ce travail, nous introduisons **StreamSplat**, un cadre entièrement feed-forward qui transforme instantanément des flux vidéo non calibrés de longueur arbitraire en représentations dynamiques 3D Gaussian Splatting (3DGS) de manière en ligne. Elle est réalisée grâce à trois innovations techniques clés : 1) un mécanisme d’échantillonnage probabiliste qui prédit robustement les Gaussiennes 3D à partir d’entrées non calibrées; 2) un champ de déformation bidirectionnel qui fournit des associations fiables entre les référentiels et atténue l’accumulation d’erreurs à long terme; 3) une opération de fusion gaussienne adaptative qui propage les gaussiennes persistantes tout en gérant celles émergentes et nulles. Des expériences approfondies sur des benchmarks dynamiques et statiques standards démontrent que StreamSplat atteint une qualité de reconstruction et une modélisation dynamique de scènes à la fine pointe. De manière unique, notre méthode permet la reconstruction en ligne de flux vidéo arbitrairement longs avec une accélération de 1200 $ $ par rapport aux méthodes basées sur l’optimisation. Notre code et nos modèles seront rendus accessibles au public.

TLDR : Nous avons proposé un cadre efficace, évolutif et axé sur l’avance pour la reconstruction dynamique 3D en ligne.

StructEval : Benchmarking des capacités des LLM à générer des résultats structurels

Jialin Yang, Dongfu Jiang, Wenhu Chen (membre du corps professoral de Vector), Ping Nie

Résumé :

As Large Language Models (LLMs) become integral to software development workflows, their ability to generate structured outputs has become critically important. We introduce $\textbf{StructEval}$, a comprehensive benchmark for evaluating LLMs’ capabilities in producing both non-renderable (JSON, YAML, CSV) and renderable (HTML, React, SVG) structured formats. Unlike prior benchmarks, StructEval systematically evaluates structural fidelity across diverse formats through two paradigms: $\textbf{1)}$ generation tasks, producing structured output from natural language prompts, and $\textbf{2)}$ conversion tasks, translating between structured formats. Our benchmark encompasses 18 formats and 44 types of task, with novel metrics for format adherence and structural correctness. Results reveal significant performance gaps—even state-of-the-art models like o1-mini achieve only $75.58$ average score, with open-source alternatives lagging approximately $10$ points behind. We find generation tasks more challenging than conversion tasks, and producing correct visual content more difficult than generating text-only structures.

Hyperréseaux de graphes sensibles à la structure pour la synthèse des programmes neuronaux

Wenhao Li, Yudong Xu, Elias Khalil (ancien affilié du corps professoral Vector), Scott Sanner (affilié du corps professoral Vector)

Résumé :

We study the neural program synthesis of $\textit{parameterized}$ function families through the lens of meta-learning with hypernetworks. Given a user intent $U$, a meta-learner $M_{\phi}$ produces a full weight set $\hat{\theta}=M_{\phi}(U)$ for a target neural network with fixed architecture $S$, and the instantiated network $m_{S,\hat{\theta}}(X)\to Y$ realizes the behavior intended for $U$. Classical hypernetworks typically $\textit{ignore the target network’s structure}$ and emit a flat list of weights; as a consequence, they fail to account for $\textit{neuron-permutation symmetry}$—many distinct parameterizations of $S$ implement the same function—so equivalent solutions are treated as different targets, fragmenting supervision and hurting out-of-distribution generalization. To address this, we propose $\textit{Meta-GNN}$, a hypernetwork that constructs a $\textit{neural graph}$ from the target architecture $S$ and applies $\textbf{structure-aware}$ message passing with parameter-tied encoders and decoders. This design reduces the search space during learning by collapsing equivalent classes of target networks, without loss of expressivity. Empirically, across modular arithmetic ($\textit{AddMod}$-$p$), array operations ($\textit{SumFirst}$-$n$), and inverse-rule tasks from 1D-ARC, $\textit{Meta-GNN}$ substantially improves learning and $\textbf{out-of-distribution generalization}$ compared to classic hypernetworks and direct $(U,X)\to Y$ baselines. Mechanistic analyses reveal $\textit{what is learned}$: on $\textit{AddMod}$-$p$ the synthesized Transformers recover the canonical clock representation and admit a compact closed-form map $U\mapsto\theta$. These results demonstrate that structure-aware Meta-GNNs enable reliable generalization to $\textit{unseen program parameterizations}$, providing a critical advance for the nascent field of neural program synthesis.

TL; DR : Nous montrons qu’un hyperréseau conscient de la structure peut générer directement des poids complets du réseau de neurones — traitant les poids comme une modalité de programme continue — et surpasser les lignes de base grâce à une forte généralisation zéro sur des tâches invisibles.

Adaptation en temps de test pour les agents LLM via l’interaction avec l’environnement

Arthur Chen, Zuxin Liu, Jianguo Zhang, Akshara Prabhakar, Zhiwei Liu, Shelby Heinecke, Silvio Savarese, Victor Zhong (membre du corps professoral de Vector), Caiming Xiong

Résumé :

Les agents basés sur les grands modèles de langage (LLM) ont du mal à généraliser à des environnements nouveaux et complexes, comme des sites web invisibles ou de nouveaux ensembles de fonctions, en raison d’un décalage fondamental entre leurs conditions de pré-entraînement et de temps de test. Ce défi découle de deux modes de défaillance distincts : une mauvaise compréhension syntaxique des composants spécifiques à l’environnement comme les formats d’observation, et une mauvaise compréhension sémantique de la dynamique des transitions d’état, qui ne sont révélées qu’au moment du test. Pour répondre à ces enjeux, nous proposons deux stratégies distinctes et complémentaires pour adapter les agents LLM en tirant parti des informations spécifiques à l’environnement disponibles lors du déploiement. Premièrement, une méthode d’adaptation distributive en ligne paramétrise les nuances environnementales en apprenant un vecteur d’adaptation léger qui biaise la distribution de sortie du modèle, permettant un alignement rapide avec un format de réponse environnementale. Deuxièmement, une méthode d’ancrage de la dynamique en temps de déploiement utilise une phase d’exploration pilotée par la persona pour sonder systématiquement et apprendre la dynamique causale de l’environnement avant l’exécution de la tâche, équipant l’agent d’un modèle de monde non paramétrique. Nous évaluons ces stratégies à travers divers repères agentiques, incluant l’appel de fonctions et la navigation web. Nos résultats empiriques démontrent l’efficacité des deux stratégies à travers tous les benchmarks avec un coût computationnel minimal. Nous constatons que l’ancrage dynamique est particulièrement efficace dans des environnements complexes où les dynamiques imprévisibles posent un obstacle majeur, démontrant une voie robuste vers des agents basés sur LLM plus généralisables et capables. Par exemple, dans la division multi-sites WebArena, cette méthode augmente le taux de réussite de l’agent de 2% à 23%.

TLDR : Nous proposons un cadre appelé adaptation au temps de test fondé pour adapter les agents basés sur des LLM à des environnements nouveaux et complexes.

Propagation en équilibre textuel pour les systèmes d’IA composés profonds

Minghui Chen, Wenlong Deng, James y Zou, Han Yu, Xiaoxiao Li (membre du corps professoral de Vector)

Résumé :

Les grands modèles de langage (LLM) sont de plus en plus déployés dans le cadre de systèmes d’IA composés qui coordonnent plusieurs modules (par exemple, récupérateurs, outils, vérifiateurs) sur des flux de travail à long terme. Bien que les cadres récents qui propagent la rétroaction textuelle à l’échelle mondiale (par exemple, TextGrad rendent possible l’optimisation de tels pipelines), nous identifions deux modes de défaillance à l’échelle de profondeur dans les flux de travail agents à long horizon : 1) gradient textuel explosif, où la rétroaction textuelle croît exponentiellement avec la profondeur, menant à un message prohibitivement long et amplifiant les biais d’évaluation; et 2) le gradient textuel nul, où la capacité limitée dans le contexte long fait que les modèles surmettent l’accent sur la rétroaction récente ou précoce, tandis que la compression des rétroactions longues fait perdre progressivement leur spécificité aux messages en aval à mesure qu’ils se propagent de nombreux sauts en amont. Pour atténuer ces problèmes, nous introduisons la propagation en équilibre textuel (TEP), un principe d’apprentissage local inspiré de la propagation en équilibre dans les modèles basés sur l’énergie. La TEP comprend deux phases : 1) une phase libre où un LLM local affine de manière itérative les prompts jusqu’à atteindre un équilibre (aucune amélioration supplémentaire n’est suggérée); et 2) une phase poussée qui applique des modifications de prompts proximales avec une intensité de modification bornée, en utilisant des objectifs au niveau de la tâche qui se propagent par signalisation directe plutôt que par chaînes de rétroaction en arrière. Cette conception soutient l’optimisation locale des prompts suivie d’une adaptation contrôlée vers les objectifs globaux sans la charge computationnelle ni la dégradation du signal de la rétropropagation textuelle globale. À travers les benchmarks d’assurance qualité à long terme et les ensembles de données multi-agents utilisant des outils, le TEP améliore constamment la précision et l’efficacité par rapport aux méthodes de propagation globales comme TextGrad, avec des gains qui augmentent à plus grande profondeur, tout en préservant la praticité des composants LLM boîte noire dans les systèmes d’IA composés profonds.

Plus épais et plus rapide : le jeton géant pour transformateurs rapides à vision claire

Anthony Fuller, Yousef Yassin, Daniel Kyrollos, Evan Shelhamer (membre du corps professoral de Vector), James Green

Résumé :