Par Arber Kacollja

Le récent atelier de théorie de l’apprentissage automatique du Vector Institute a réuni des chercheurs en théorie de l’apprentissage automatique pour présenter leurs dernières recherches, discuter de sujets de pointe et partager des perspectives sur les fondements théoriques de l’apprentissage automatique. L’événement, organisé par Shai Ben-David, membre du corps professoral de Vector, et Ruth Urner, affiliée au corps professoral de Vector, s’est tenu à l’Université de Waterloo en novembre.

Les théoriciens de l’apprentissage automatique jouent un rôle central en relevant les défis et en posant de nouvelles questions fondamentales dans le domaine. En approfondissant les aspects fondamentaux de l’apprentissage automatique, ils contribuent au développement de nouveaux concepts qui peuvent avoir un impact transformateur sur les méthodologies de résolution de problèmes. En fin de compte, leurs contributions peuvent provoquer un changement de paradigme dans la manière dont les enjeux complexes de l’IA sont abordés.

Les participants se sont réunis à l’Université de Waterloo pour l’atelier de théorie de l’apprentissage automatique de Vector en novembre.

Au cours de l’atelier d’une journée entière, des membres du corps professoral, des membres affiliés du corps professoral, des boursiers postdoctoraux et des chercheurs de la communauté Vector au sens large ont entendu des conférences de certains des meilleurs théoriciens de l’apprentissage automatique qui couvraient un large éventail de sujets sur les fondements mathématiques de l’apprentissage automatique. Les participants ont également participé à des discussions de groupe interactives ainsi qu’à une séance d’affiches où des étudiants diplômés ont présenté leurs recherches.

Shai Ben-David, membre du corps professoral de Vector, souhaite la bienvenue aux participants à l’atelier.

Ben-David a discuté des notions possibles de caractérisations et dimensions de la capacité d’apprentissage. Le théorème fondamental de l’apprentissage statistique affirme que la dimension de Vapnik–Chervonenkis (VC) caractérise l’apprentissabilité des classes pour la tâche de prédiction d’étiquettes binaires. Des caractérisations similaires peuvent-elles être fournies pour d’autres tâches d’apprentissage telles que la prédiction multi-classes, les distributions de probabilité d’apprentissage non supervisées et plus encore? Ben-David, qui est titulaire de la chaire CIFAR au Canada en IA et professeur à la David Cheriton School of Computer de l’Université de Waterloo, a également expliqué les résultats récents de son laboratoire à l’Université de Waterloo indiquant l’absence de telles dimensions pour l’apprentissage statistique général et pour l’apprentissage des classes de distributions de probabilité.

Au-delà des paradigmes classiques de statistique et d’informatique

Murat Erdogdu, membre de la faculté vectorielle et président canadien de l’IA au CIFAR, ainsi que les chercheurs de ce laboratoire étudient l’effet de l’optimisation basée sur le gradient sur l’apprentissage des caractéristiques dans les réseaux de neurones à deux couches. Dans sa présentation, Erdogdu, qui est aussi professeur adjoint au département d’informatique et au département des sciences statistiques de la Faculté des arts et des sciences de l’Université de Toronto, a examiné un contexte où le nombre d’échantillons est du même ordre que la dimension d’entrée et a montré que, lorsque les données d’entrée sont isotropes, la descente du gradient améliore toujours le modèle initial de caractéristiques aléatoires en termes de risque de prédiction, pour une certaine catégorie de cibles. En s’appuyant davantage sur l’observation pratique que les données contiennent souvent une structure supplémentaire, c’est-à-dire que la covariance d’entrée a un alignement non trivial avec la cible, les travaux du groupe de recherche prouvent que la classe de cibles apprenables peut être considérablement étendue, démontrant une séparation claire entre les méthodes de noyau et les réseaux neuronaux à deux couches dans ce régime.

Les réseaux de neurones sont devenus si vastes que leur comportement peut être bien approximé par des « réseaux de neurones infinis », obtenus en considérant la limite du nombre de neurones vers l’infini. Cependant, il existe de nombreuses limites infinies possibles que l’on peut prendre. Par exemple, une limite bien connue est la limite du « noyau tangent neuronal » (NTK), où la profondeur est fixe et la largeur de la couche va à l’infini.

Mihai Nica, membre affilié de la faculté vectorielle et professeur adjoint à l’Université de Guelph, a introduit une limite infinie alternative, la limite infinie de profondeur et de largeur, où la profondeur et la largeur sont simultanément dimensionnées à l’infini. Cela conduit à des distributions exotiques non gaussiennes très différentes du comportement de type NTK mais qui correspondent plus précisément à la sortie des réseaux de neurones finis.

Au cours de la dernière décennie, un corpus de riches prédictions a été fait sur les spectres des matrices empiriques de Hessos et d’information au cours de l’entraînement (via la descente du gradient stochastique) dans des réseaux surparamétrés. Aukosh Jagannath, professeur adjoint à l’Université de Waterloo, a présenté des travaux récents réalisés en collaboration avec Gérard Ben Arous, Reza Ghessari et Jiaoyang Huang, où ils établissent rigoureusement certaines de ces prédictions. La présentation s’est concentrée sur leurs résultats pour un analogue à haute dimension du problème XOR, montrant que la trajectoire de descente du gradient stochastique (SGD) s’aligne rapidement avec les espaces propres émergents des valeurs propres de bas rang des matrices de Hesse et gradient; cet alignement se produit par couche, l’espace propre des valeurs aberrantes de la couche finale évoluant au fil de l’entraînement et présentant un déficit de rang lorsque le SGD converge vers des classificateurs sous-optimaux.

Vers un système d’apprentissage automatique robuste et fiable

Sivan Sabato, membre du corps professoral de Vector et président IA du CIFAR au Canada, également professeur agrégé à l’Université McMaster, a discuté du potentiel et des défis liés à l’utilisation des explications comme entrée d’un algorithme d’apprentissage. L’objectif est que les systèmes d’apprentissage automatique puissent apprendre beaucoup plus rapidement grâce à l’expérience s’ils entendent aussi des explications d’un enseignant compétent, tout comme les gens le font.

Par exemple, lorsqu’on apprend à diagnostiquer automatiquement les patients, les gens utilisent généralement des données historiques sur les patients précédents et leurs diagnostics. Cependant, le processus pourrait être beaucoup plus efficace si le système d’apprentissage pouvait aussi demander aux médecins d’expliquer certains diagnostics. Autre exemple, les logiciels et sites web pourraient mieux se personnaliser pour des utilisateurs spécifiques, s’ils permettent aux utilisateurs d’expliquer leurs préférences.

Intégrer des explications dans le processus d’apprentissage nécessite de comprendre comment elles peuvent être utilisées et comment elles devraient être interprétées par l’algorithme. Peut-être que l’aspect le plus difficile est de faire en sorte que le système d’apprentissage prenne en compte le fait que les explications peuvent être utiles, mais peuvent aussi parfois être erronées. Un système d’apprentissage robuste doit utiliser les explications avec prudence, afin de pouvoir bénéficier de bonnes explications sans être trop sensible aux mauvaises explications. Cette présentation proposait des méthodes pour y parvenir.

Ruth Urner, affiliée à Vector Faculty, présente sa conférence « Modèles d’adversaires ».

Urner, également professeure agrégée à l’Université York, a centré sa conférence sur la manière dont les exigences de robustesse adversaire peuvent être adéquatement modélisées. Elle a examiné comment différentes hypothèses de modélisation peuvent mener à des conclusions radicalement différentes. Urner soutenait que nous devrions viser des hypothèses minimales sur la manière dont un adversaire pourrait agir, et a présenté des résultats récents sur diverses assouplissement de l’apprentissage avec le cadre standard de robustesse adversaire (ou stratégique).

Dans cette optique, l’apprentissage statistique repose traditionnellement sur la génération de données d’entraînement et de tests par le même processus, mais les instances peuvent (stratégiquement ou adversement) répondre à un prédicteur publié visant un résultat précis. De telles manipulations des données au moment du test peuvent entraîner des défaillances inattendues d’un modèle appris. Un grand nombre d’études de recherche, tant pratiques qu’théoriques, visent à atténuer les risques de sécurité qui en résultent en développant des méthodes robustes face aux perturbations adversaires.

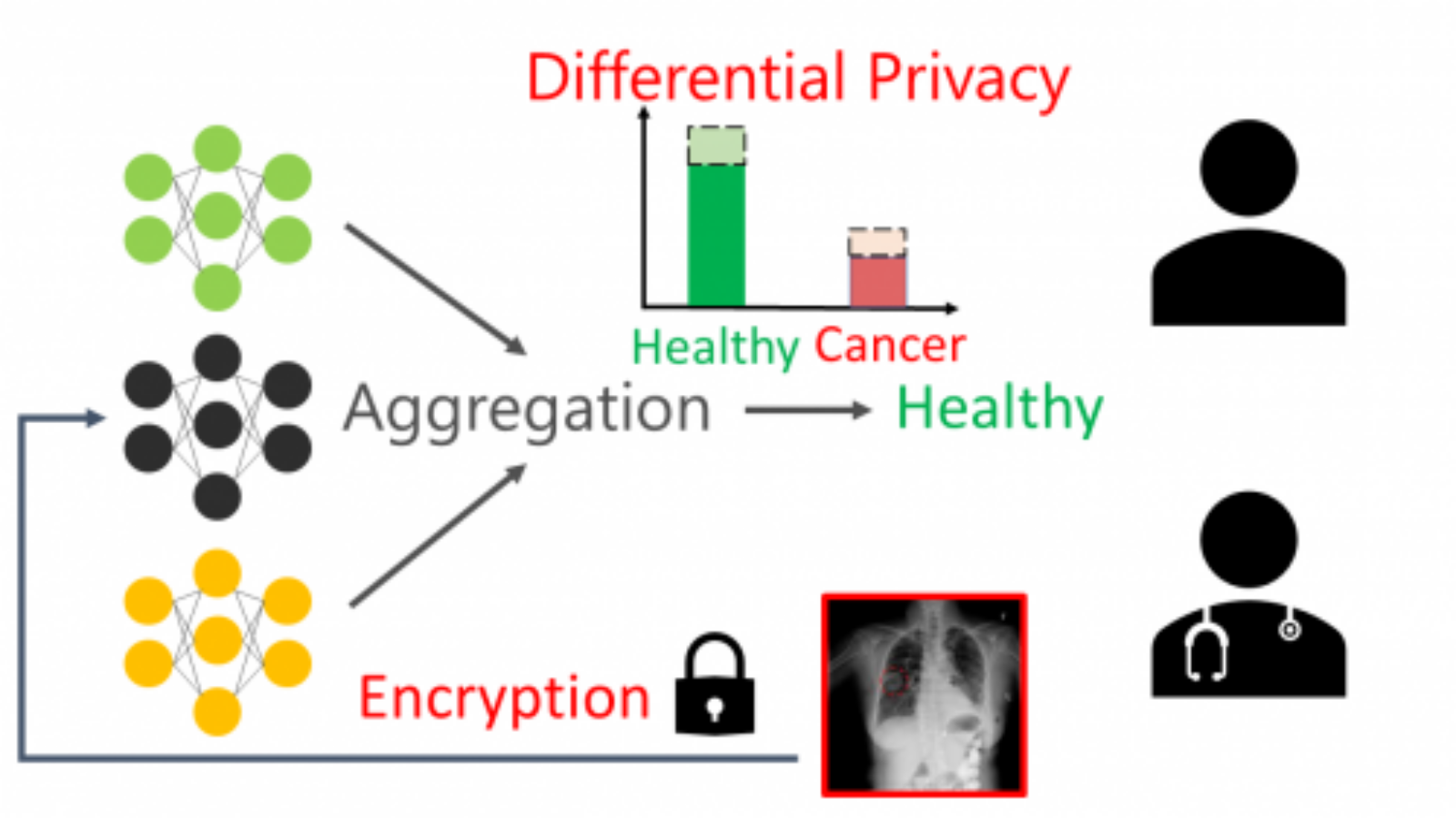

Estimation statistique sous contraintes de confidentialité différentielles

Gautam Kamath, membre du corps professoral de Vector et président canadien de l’IA au CIFAR, s’est concentré sur les recherches de son groupe sur l’estimation statistique sous contraintes de confidentialité. L’estimation statistique concerne des tâches fondamentales comme comprendre les motifs sous-jacents à un ensemble de données, ou calculer certaines statistiques agrégées comme la moyenne. La question pertinente est de savoir comment faire cela sans divulguer des informations sensibles sur des points de données individuels dans l’ensemble de données. Kamath, qui est également professeur adjoint à la David R. Cheriton School of Computer Science de l’Université de Waterloo, a parlé d’une multitude de nouveaux enjeux qui surviennent dans le secteur privé et de la manière de les aborder, notamment les compromis liés au biais statistique, aux données à queues lourdes et aux priorités sur l’ensemble de données.

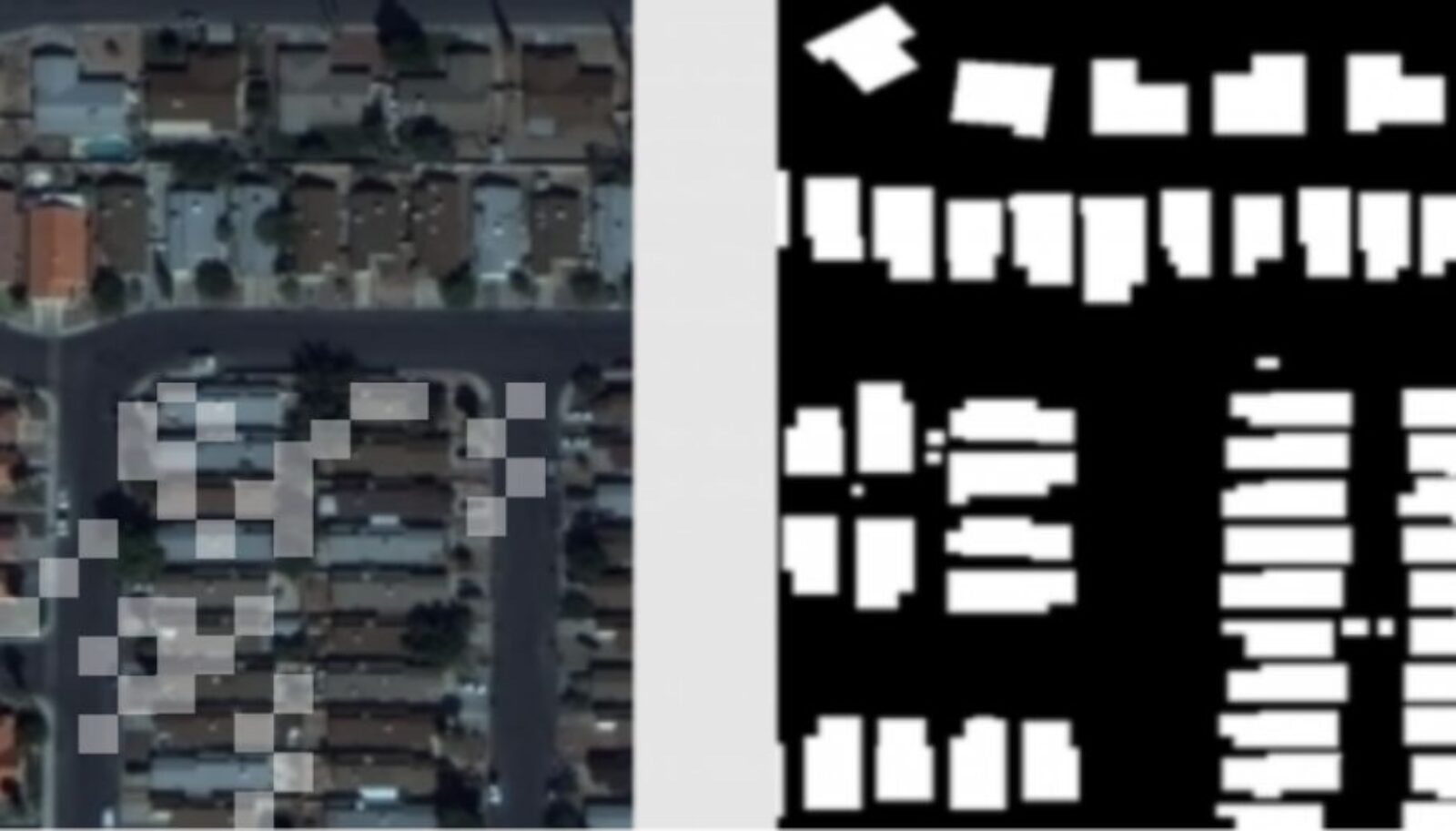

De plus, Hassan Ashtiani, affilié à Vector Faculty et également professeur adjoint à l’Université McMaster, a parlé de l’apprentissage privé des modèles de mélange gaussiens (GMM). Les GMM représentent une riche classe de distributions qui ont été utilisées pour modéliser divers phénomènes scientifiques, notamment dans les premiers travaux de Karl Pearson dans les années 1890 pour étudier les caractéristiques des crabes rivaux. Ces dernières années, un intérêt important a été suscité pour la conception d’algorithmes optimaux par échantillonnage et efficaces en calcul pour l’estimation des GMG.

Cependant, concevoir des méthodes différencieusement privées pour apprendre les GMM a été difficile. Fait intéressant, certaines de ces difficultés représentent des lacunes fondamentales dans notre compréhension de l’estimation statistique privée. Dans son exposé, Ashtiani a exposé certains de ces défis, ainsi que des approches génériques pour les résoudre. Un thème commun était d’utiliser les estimateurs non privés comme une boîte noire, de « stabiliser » les résultats des estimateurs non privés, puis d’agréger les résultats de manière différenciellement privée. Les résultats comprenaient la première réduction computationnellement efficace pour l’estimation de paramètres privés vers non privés pour les GMG, ainsi que le premier résultat d’apprentabilité pour les GMM dans le contexte d’estimation de densité.

Parmi les autres moments forts de l’événement, on compte la discussion de Yaoliang Yu, membre du corps professoral de Vector, sur l’empoisonnement des données, la compression de modèles et l’estimation de valeur (liée à Shapley), ainsi que la présentation de Daniel Roy, membre du corps professoral de Vector et codirecteur de recherche, sur l’application des infinitésimaux aux problèmes ouverts en théorie statistique de la décision.

Le travail des théoriciens de l’apprentissage va au-delà de la simple résolution de problèmes; elle sert de catalyseur pour une compréhension plus profonde des phénomènes émergents. En explorant les principes fondamentaux qui sous-tendent l’apprentissage automatique, les théoriciens de l’apprentissage fournissent des perspectives qui non seulement améliorent l’efficacité des systèmes existants, mais ouvrent aussi la voie au développement d’approches de pointe. Essentiellement, leurs contributions constituent la base de l’évolution continue de l’apprentissage automatique et de l’intelligence artificielle, façonnant le paysage de ces domaines dynamiques.

Vous souhaitez en savoir plus sur les initiatives de recherche actuelles de l’Institut Vector en théorie de l’apprentissage automatique? Cliquez ici pour la liste de lecture complète des conférences.