Hassan Ashtiani, professeur, Université McMaster | Membre du corps professoral de l’Institut Vector

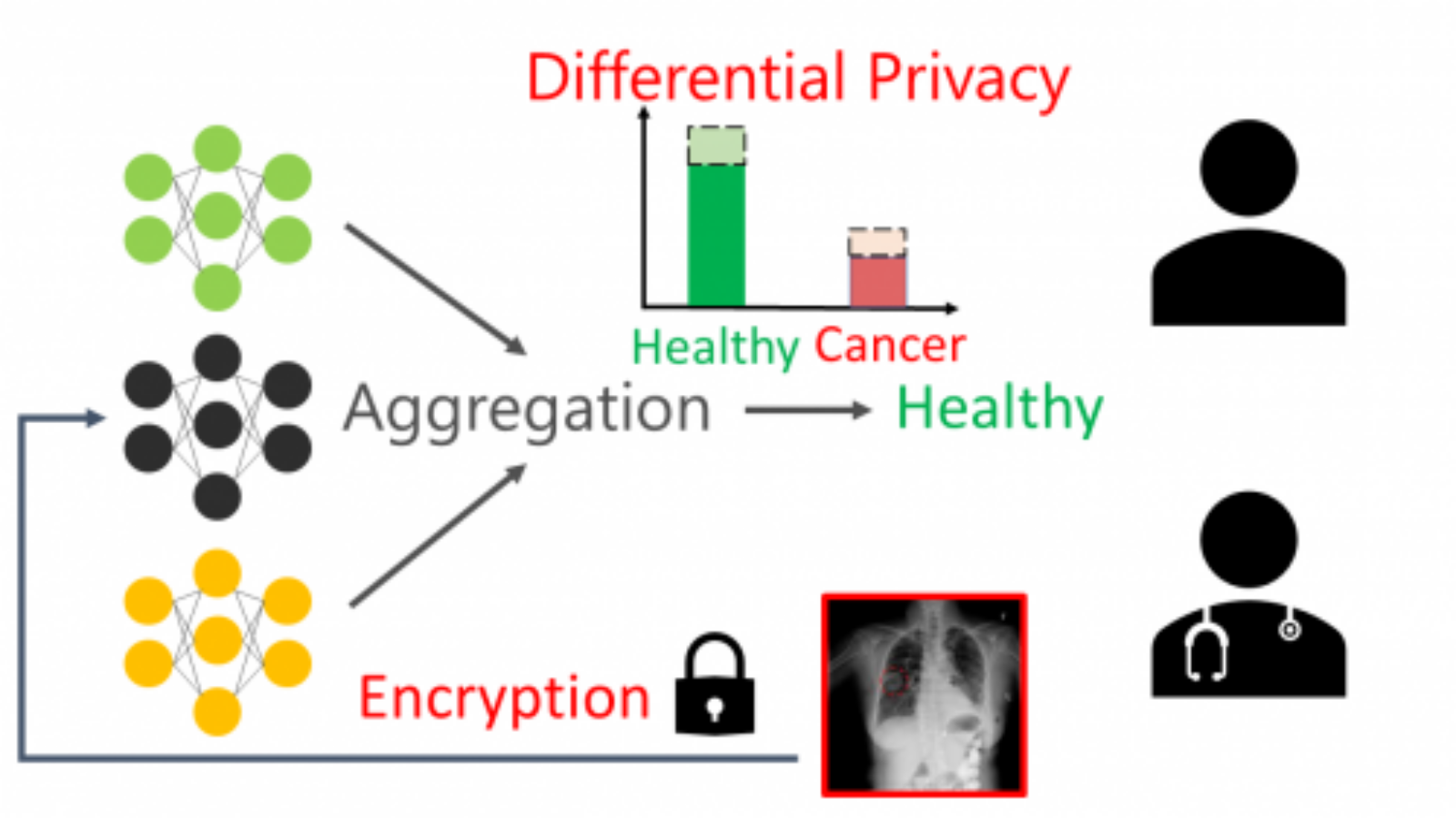

Vous voulez partager vos données médicales pour faire avancer la recherche, mais vous ne voulez pas que d’autres accèdent à vos informations privées. La solution intuitive – simplement supprimer son nom et anonymiser les données – a été tentée à plusieurs reprises. Malheureusement, ça ne fonctionne pas. Les gens peuvent encore trouver des détails importants à votre sujet grâce à des motifs dans les données, des recoupements avec d’autres ensembles de données ou des inférences statistiques.

Les recherches de Hassan Ashtiani portent sur les raisons pour lesquelles les approches ad hoc en matière de vie privée échouent et ce qui est nécessaire à la place : des preuves mathématiques qui garantissent que la vie privée sera maintenue, même en présence d’adversaires sophistiqués. En tant que membre du corps professoral en vecteurs et professeur à l’Université McMaster, il travaille sur les fondements théoriques qui rendent les systèmes d’IA prouvablement privés, robustes et dignes de confiance.

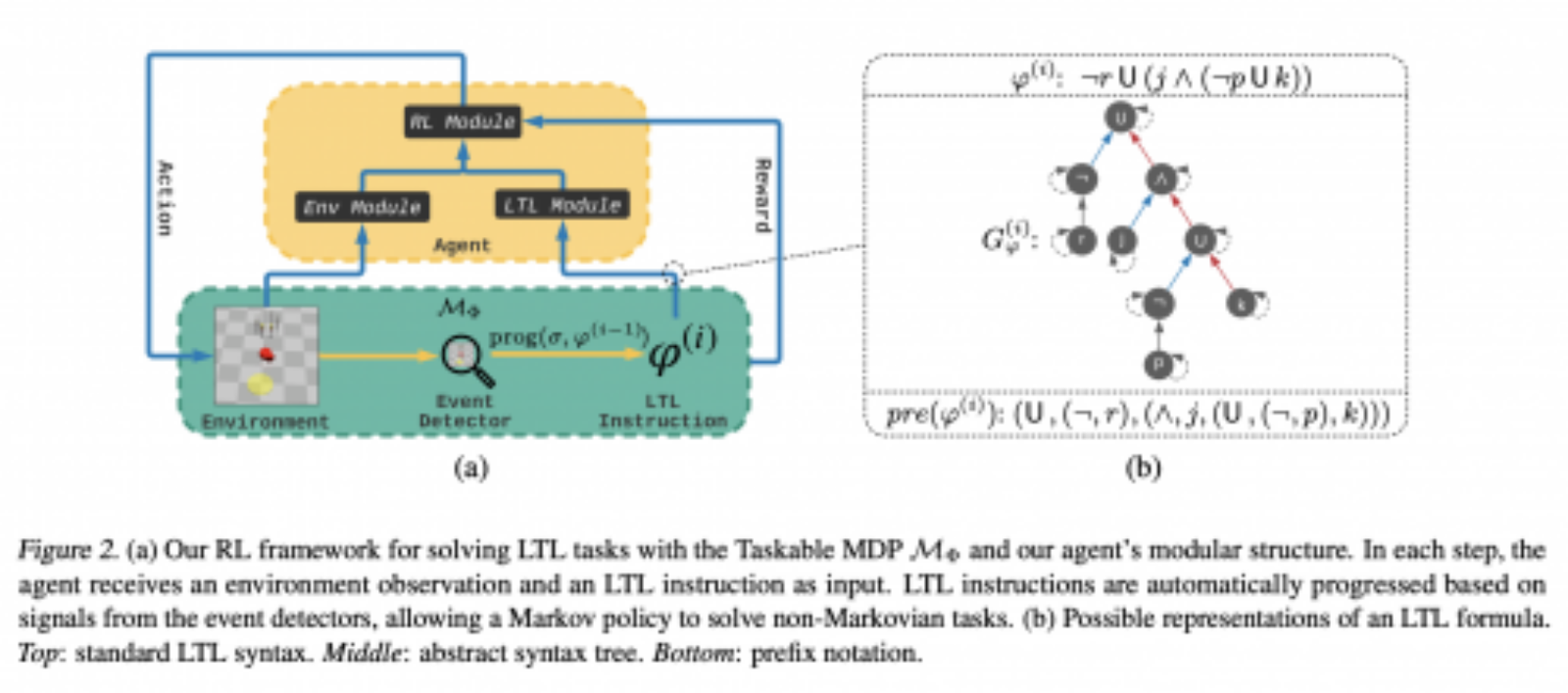

Ce n’est pas du travail purement académique. Dans des domaines comme la santé et les systèmes autonomes, nous avons besoin de garanties qui vont au-delà de « probablement assez bonnes ». Lorsque les systèmes d’IA prennent des décisions importantes – diagnostiquer des maladies, approuver des prêts ou contrôler des véhicules – nous devons prouver mathématiquement qu’ils préserveront leur vie privée, résisteront aux attaques et se comporteront de manière fiable dans des conditions réelles.

D’étudiant à membre du corps professoral : un parcours vectoriel

La relation d’Ashtiani avec Vector a commencé en 2018 alors qu’il était doctorant à l’Université de Waterloo, lorsqu’il a rejoint le tout premier programme d’affiliation aux cycles supérieurs. Cette exposition précoce lui a permis de découvrir l’écosystème de recherche en IA émergent de l’Ontario à un moment formateur de sa carrière. Après avoir obtenu son diplôme et accepté un poste de professeur à l’Université McMaster à Hamilton, il est passé au statut d’affilié du corps professoral en 2020, maintenant ses liens avec Vector tout en bâtissant son groupe de recherche indépendant, Intelligence artificielle pour les sciences chimiques.

Ces cinq années en tant qu’affilié ont fourni une infrastructure cruciale pour un chercheur en début de carrière. Vector a offert des occasions d’organiser des ateliers et des groupes de lecture, l’accès à des ressources informatiques pour des expériences, ainsi que des voies pour connecter ses étudiants avec des chercheurs d’autres institutions. Peut-être les plus précieuses étaient les occasions informelles – croiser un autre chercheur lors d’un événement Vector et découvrir des intérêts qui se chevauchent, ou pouvoir facilement explorer des projets collaboratifs entre universités parce que l’affiliation partagée offrait un terrain d’entente naturel et un soutien pratique.

Pour Ashtiani, la plus grande valeur de Vector a toujours été la connexion et la collaboration. Avant de déménager au Canada, établir des liens de recherche à Téhéran signifiait surmonter d’importants obstacles aux déplacements, des ressources limitées et l’isolement vis-à-vis de la communauté de recherche au sens large. Travailler à Waterloo, puis à McMaster, l’affiliation Vector a fondamentalement changé ce qui était possible. Lorsque les deux chercheurs d’une collaboration potentielle sont affiliés à Vector, la friction pratique du travail interinstitutionnel – où se rencontrer, comment accéder aux ressources partagées, s’il y a un soutien institutionnel – disparaît en grande partie. L’infrastructure permet un type de collaboration spontanée qui produit des percées inattendues.

« J’ai vraiment aimé mon temps chez Vector parce qu’on se connecte avec des gens qui partagent les mêmes idées. Si vous êtes tous les deux chez Vector, vous pouvez simplement réserver une chambre et leur parler. C’est beaucoup plus facile de collaborer avec quelqu’un en dehors de ton université. »

Concevoir des systèmes qui ne nécessitent pas de réinventer la roue

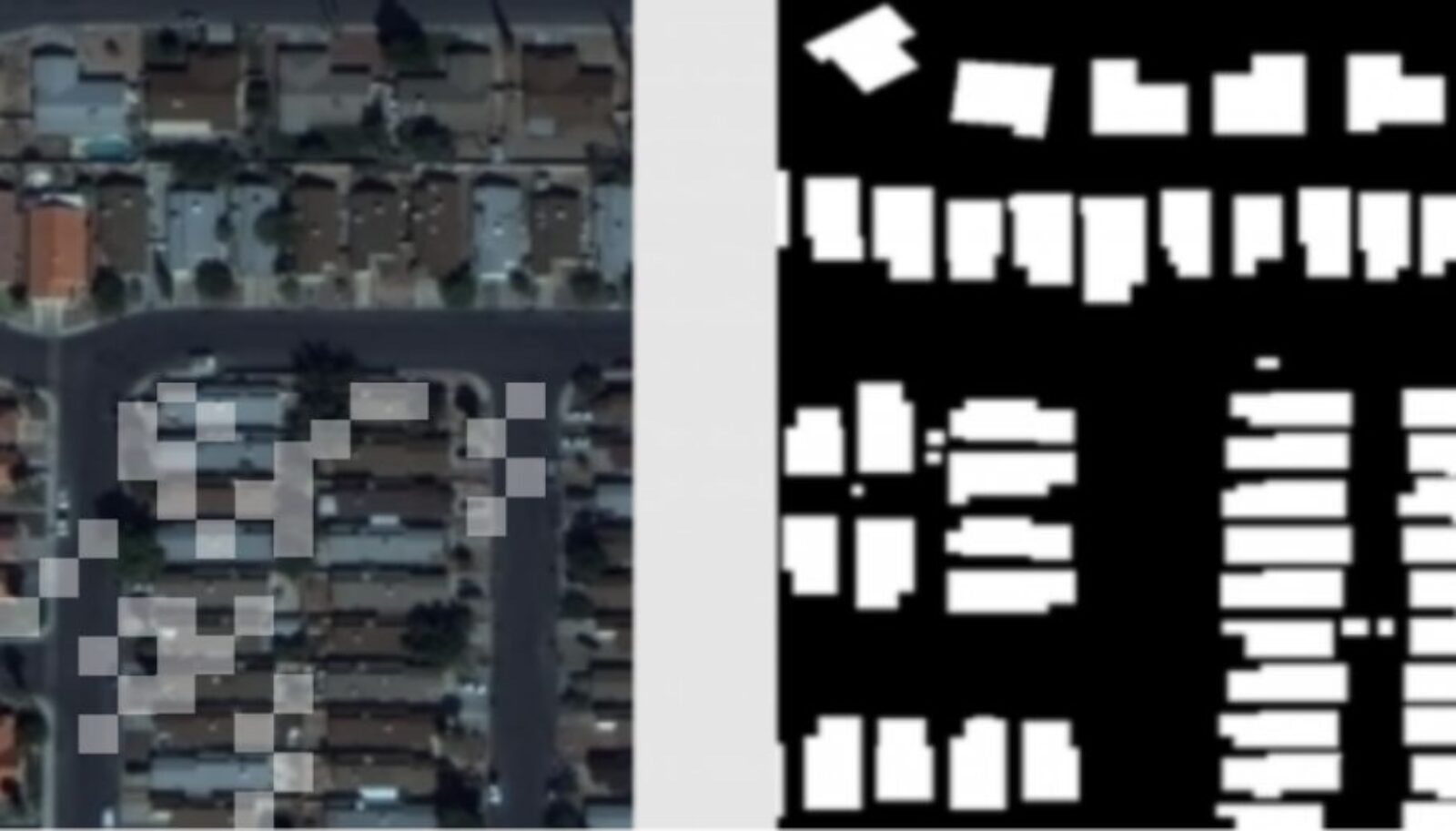

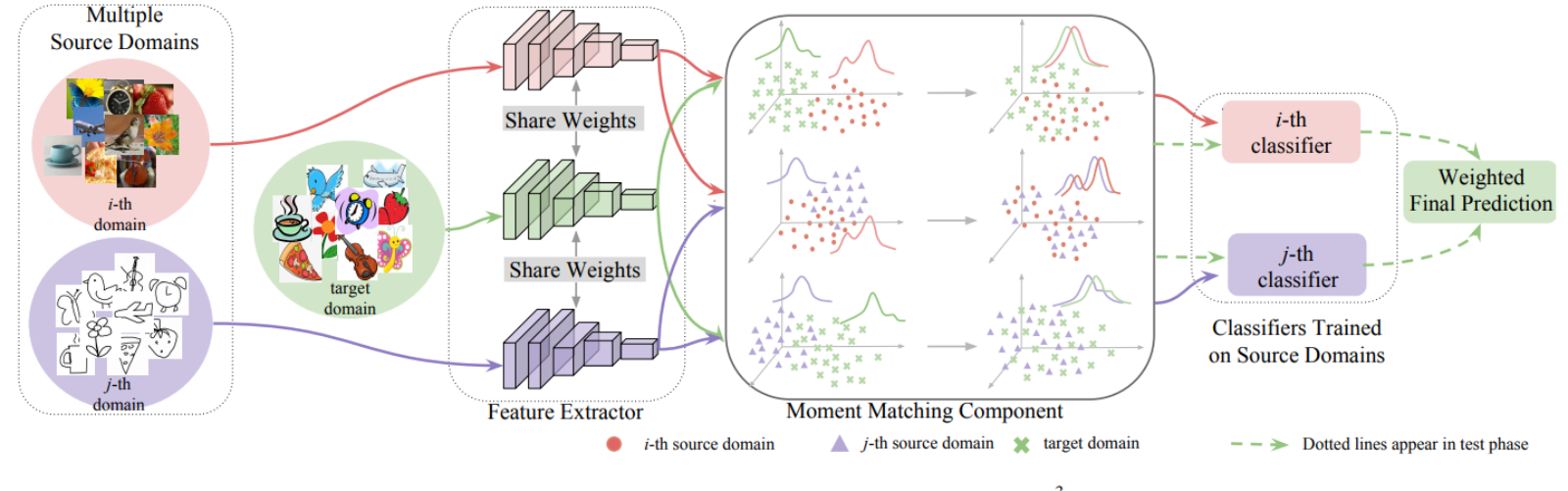

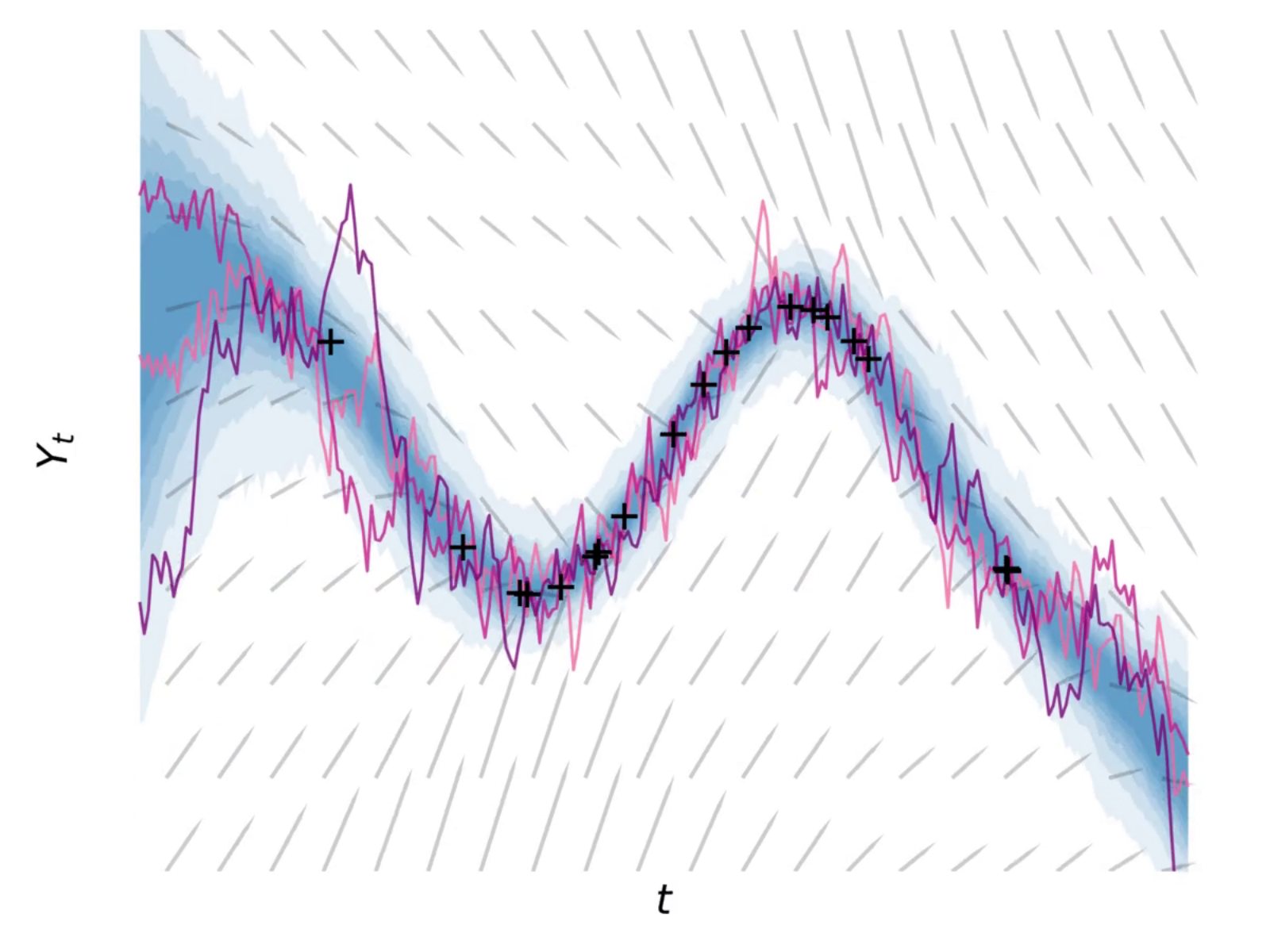

Un défi central dans l’apprentissage automatique préservant la vie privée est l’efficacité : les chercheurs doivent-ils développer des méthodes complètement nouvelles pour chaque application? Si une technique standard d’apprentissage automatique fonctionne bien pour l’analyse de données non privée, y a-t-il un moyen de l’adapter à des contextes préservant la vie privée sans repartir de zéro?

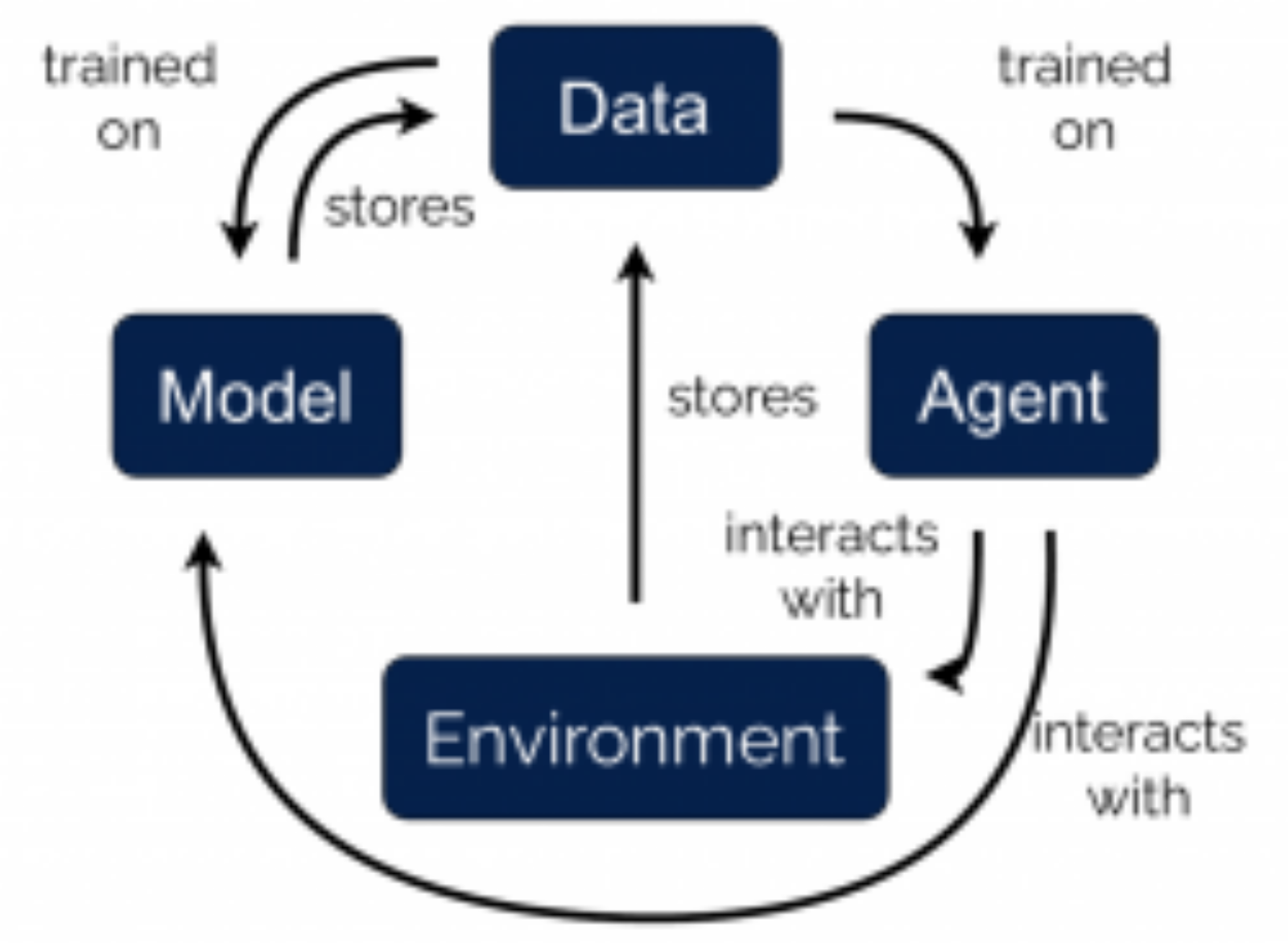

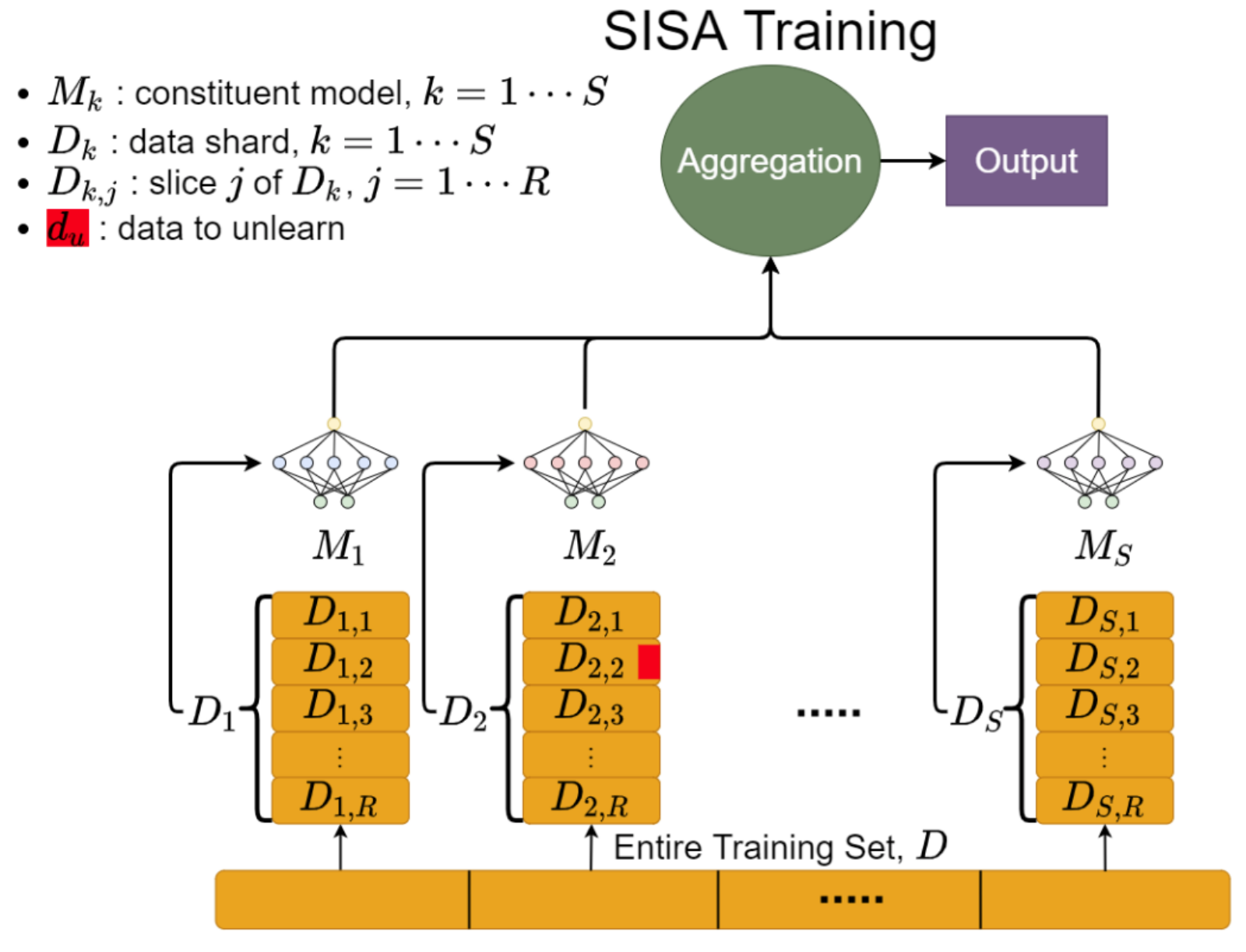

Les travaux d’Ashtiani sur les « réductions de boîte noire » abordent directement ce problème. Une boîte noire, en informatique et en apprentissage automatique, est un système où vous pouvez observer les entrées et sorties sans avoir besoin de comprendre le fonctionnement interne. Une réduction par boîte noire signifie que vous pouvez prendre n’importe quelle méthode d’apprentissage automatique existante – la traitant comme une boîte noire – et l’envelopper dans un cadre qui garantit la confidentialité, sans avoir à repenser la méthode elle-même.

Cette approche signifie que la vaste bibliothèque de techniques d’apprentissage automatique développées pour des environnements non privés peut potentiellement être adaptée efficacement pour des applications préservant la confidentialité. Plutôt que de réinventer chaque algorithme, les chercheurs peuvent tirer parti de méthodes existantes et bien testées tout en ajoutant des garanties mathématiques de confidentialité. Cela accélère considérablement le développement de systèmes privés d’apprentissage automatique. Ce travail a reçu un prix NeurIPS 2018 du meilleur article pour ses recherches sur l’apprentissage des mélanges gaussiens – un problème fondamental en statistiques et apprentissage automatique. L’article a introduit de nouveaux concepts théoriques comme des schémas de compression d’échantillons pour les distributions qui ont fait progresser la compréhension de la quantité de données fondamentalement nécessaire pour apprendre des modèles complexes.

Favoriser l’écosystème de l’IA du Canada tout en protégeant la vie privée des Canadiens

Les enjeux pratiques de cette recherche s’étendent directement à la capacité du Canada à développer et déployer des systèmes d’IA de manière responsable. L’Ontario et le Canada ont bâti un écosystème d’IA florissant, mais cet écosystème fait face à de réelles contraintes concernant l’accès aux données. Les gens sont à juste titre préoccupés par le partage d’informations personnelles, et les réglementations exigent de plus en plus de fortes protections de la vie privée. Pour les applications en soins de santé en particulier, de meilleurs systèmes de diagnostic exigent des données des patients, mais les patients ont besoin de garanties fiables que leurs informations médicales privées ne seront pas exposées.

Les recherches d’Ashtiani contribuent à résoudre cette tension en développant des méthodes qui offrent des garanties formelles et prouvées de la vie privée tout en permettant un apprentissage automatique significatif à partir de données sensibles. Si nous pouvons garder les données des Canadiens plus privées tout en permettant de meilleurs systèmes d’apprentissage automatique pour les applications médicales et autres domaines, nous renforcerons simultanément la protection de la vie privée et la capacité de l’écosystème de l’IA à prospérer.

Le travail n’est pas terminé. Les méthodes actuelles d’apprentissage automatique préservant la confidentialité impliquent souvent des compromis entre la solidité de la confidentialité et la précision du modèle. Les recherches en cours d’Ashtiani visent à réduire cet écart, en développant des approches qui maintiennent une forte confidentialité tout en atteignant une précision plus proche des systèmes non privés.

Son conseil pour les autres chercheurs est simple : « J’encourage vraiment les personnes en dehors de la communauté Vector, qu’elles soient des chercheurs en apprentissage automatique, en IA ou intéressées par ces domaines, à rejoindre Vector. » Le lien avec des chercheurs partageant les mêmes idées, l’infrastructure collaborative et la capacité de travailler au-delà des frontières institutionnelles font de Vector un élément précieux du paysage de la recherche en IA en Ontario. Sa progression de sept ans, d’étudiant affilié à membre du corps professoral, illustre le parcours que Vector offre aux chercheurs à différents stades de carrière.

« Si vous voulez vraiment de meilleurs systèmes d’apprentissage automatique pour, par exemple, les applications médicales, il vous faut vraiment des méthodes fiables sur lesquelles les gens peuvent compter et partager leurs données afin de trouver de meilleures solutions. Et si nous y parvenons, nous garderons les données des Canadiens plus privées. En même temps, nous aidons l’écosystème de l’IA à prospérer au Canada. »